这两天看 LibTV 这一版产品页面,我脑子里冒出来的第一个词,就是 TapNow。

画布、节点、素材流转、从灵感到视频的一整套工作区,很容易让人产生Tapnow既视感。

说实话,这种感觉很正常。因为 AI 视频走到今天,产品形态本来就在快速收敛。你要同时调度文本、图片、音频、视频,还要兼顾脚本、参考图、镜头、复用资产,最后大概率都会长成一个大画布,外加一堆节点。所以我先说结论。如果只是 UI 像,讨论还停留在第一层。真正值得写的地方,是它把 Skills 也接进来了。

我为什么第一眼想到 TapNow我专门去翻了一下 TapNow 公开文档,它自己对外讲得很直接,产品核心是 AI 原生创意画布,画布上靠节点来组织文本、图片、视频这些不同能力。

这说明什么。说明现在这类产品,前端形态已经有了一个行业共识。谁来做,只要目标都是让用户在一个空间里调度多模态模型、串起创作流程,最后看起来都会有点像。就像今天你去看很多设计软件、代码编辑器、白板工具,布局上都会趋同。因为大家面对的是同一类任务。UI 趋同,本质上是工作流趋同。但话说回来,趋同不等于可以随便照搬。如果只是画布结构像,按钮位置接近,图层逻辑相似,我会把它看成行业收敛。如果连命名、视觉节奏、交互细节、信息架构、营销文案都高度重合,外加核心页面一比一复刻,那这个问题就会变得严肃很多。到了法律层面,也很少只盯着几个按钮像不像,通常还会看整体表达、独创性、商业混淆,以及有没有系统性复用别人的成果。这件事很难一刀切,但也没有那么玄。

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

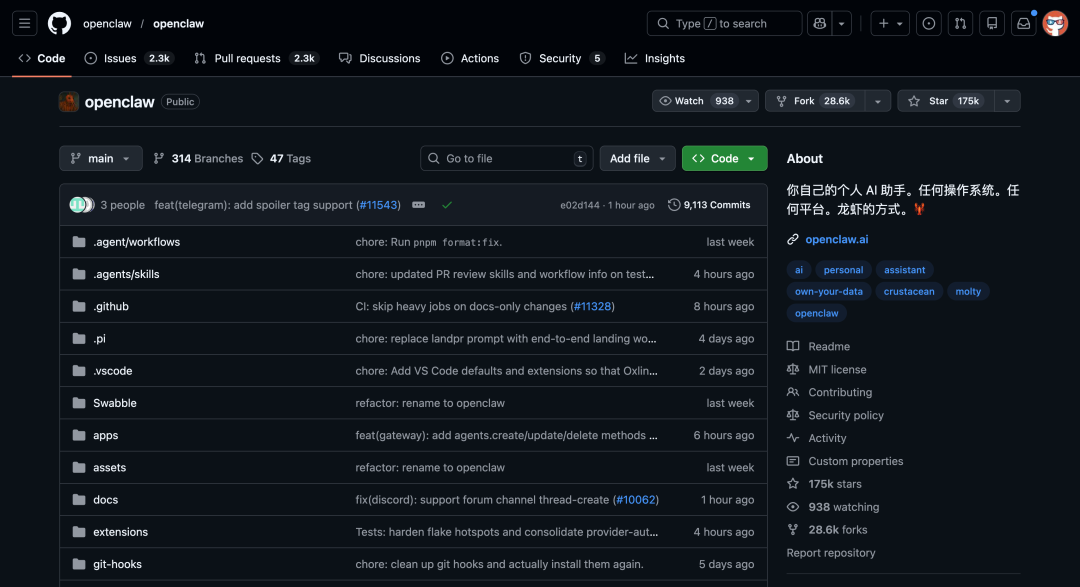

Skills 这一步,意义比页面更大我更在意的,是这次产品变化已经开始往 agent 那边走了。用一个 API key,就能让 Codex、Claude Code、OpenClaw 这类 agent 去调用平台能力,这和过去互联网那种调 API 的感觉已经很接近了。

区别只是,当年的 API 面向开发者,如今的 Skills 和工具层,开始直接面向 agent。很多人会把 Skills 理解成一个提示词包,我觉得这个理解还是浅了一层。Skills 更像一层可复用的业务能力封装。里面可以放指令、工作流、脚本、模版、领域知识,agent 在合适的时候自动发现、自动调用。这样一来,平台就不只是给人点点点用的工具,它开始变成一个可以被 agent 持续消费的能力市场。这一步一旦成立,平台的主要用户界面就会慢慢变轻。人看到的,可能只是一个聊天框,或者聊天框加一个很轻的画布。真正重的部分,会沉到后面。沉到 skills。沉到模型路由。沉到素材资产。沉到 agent 的长期记忆和执行链条里。

未来真正有价值的平台,不只是把模型接得多。它得让 agent 知道什么时候该调用什么能力,调用完以后怎么继续往下做。

这也是为什么我会觉得,LibTV 这波更像一个信号。以前大家比的是谁模型多,谁界面炫,谁生成按钮更顺手。往后看,平台会越来越像一个 agent 的操作系统。人给目标。agent 负责拆解。skills 负责调度领域能力。模型负责生成。平台负责把成本、速度、资产和结果接起来。OpenClaw 为什么会把这件事推到台前如果没有 OpenClaw 这波热点,很多人可能还不会这么快意识到,平台形态已经开始变了。因为 OpenClaw 把一件事做得非常直白,它让越来越多普通用户第一次认真去想,原来 agent 真可以自己装 skills,自己调工具,自己把事情往下做。从 OpenClaw 官方文档看,skills 本身就是一套可安装的能力模块,可以来自本地目录,也可以来自 Git 仓库。放到 LibTV 这里,你会发现它做的动作很明确,直接把 libtv-skills 放到 GitHub,再给一个 Access Key,让 OpenClaw 这类 agent 去接。这就不是单纯在做一个新网站了。它是在告诉市场,AI 视频平台接下来要服务的对象,已经不只是在页面上点按钮的人。还有一类越来越重要的用户,是站在对话框后面的 agent。

天下苦 TapNow 久矣,但贵这件事也不能只看表面现在很多人都在说 TapNow 贵。这句话我完全理解。站在用户视角,任何平台只要价格上来,第一反应肯定都是值不值。但如果把视角稍微往底层放一点,这件事就没有那么简单。AI 视频本来就是一个高算力、高试错、高返工 的赛道。尤其是最近的视频模型,已经不是单纯的文生视频了。比如火山引擎公开介绍 Seedance 2.0 时,提到它支持文本、图片、音频、视频四种模态输入,最多可以吃 9 张图片、3 段视频、3 段音频,最长生成 15 秒。

你把这种能力真正塞进一个可商用平台里,背后牵扯到的就不只是推理成本,还有素材管理、工作流编排、失败重跑、版本对比、预览、存储、多人协作这些一整套系统成本。所以很多时候,大家骂的是价格,平台扛的是一整条链路的成本。这当然不代表谁贵谁就一定合理。功能不够强,体验不够顺,定价又高,用户照样会用脚投票。但至少在现阶段,AI 视频这门生意,天然就很难便宜。有人觉得 TapNow 贵,某种程度上也说明我们已经开始用商业化产品的标准去要求它了。这个要求本身没问题,只是别把账算得太轻。更关键的一点还在后面。等 Seedance 2.0 这类接口进一步放开之后,大家最终拼的,还是功能和价格。谁能把最强的视频能力以更稳定的方式接进来,谁能把成本压到用户能接受的区间,谁就更有机会把这场仗打下来。到那个时候,页面像不像,已经没那么重要了。真正重要的是,用户一句话下去,agent 能不能把片子做出来,做得够稳,做得够便宜。而 LibTV是和 liblib 平台的会员积分共同的,也就是你在一个平台上开会员充积分,两边都能使用,这种方式对于用户来说很方便。

从公开讨论看,用户要的东西其实很朴素我这次专门去翻了一圈公开讨论,越看越觉得,用户的诉求一点都不复杂。他们最后要的就是四个词。便宜。好用。少折腾。能稳定出结果。这个结论,不只是我自己脑补出来的。AI博主在 X 上发 LibTV 相关内容后,下面就有人直接留言,问得很现实,佬你收费了吗?如果收了的话请标注一下付费。这个评论一下子就把用户情绪点出来了。大家现在对新平台、新测评都很敏感,先看你是不是广告,再看值不值得试。再看 OpenClaw 那边,用户讨论更直接。Reddit 上最近高频出现的帖子标题,焦点已经从能力炫技,转到 Can I Use OpenClaw without being Rich??、Way too many input tokens in OpenClaw、Does the revenue cover the costs? 这些话翻成大白话就一句,别让我为了一个还不稳定的工作流,先把成本烧穿。所以从用户视角看,LibTV、TapNow、后面的更多平台,最后都得回答同一组问题:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

我甚至觉得,这部分比产品宣发里的各种新概念更重要。用户不会为一个概念长期付费。用户会为稳定、省钱、省时间的结果付费。我们自己实操下来,有三个点确实挺有用说了这么多判断,再落回实操。这次看完你给的参考资料,我反而更确定一件事,LibTV 真正能打动创作者的,不是那些大词,还是你能不能在具体创作里省下一步、两步、三步。我们自己会重点看三个功能。1. 多角度,不用重写一堆提示词这一点其实很实用。同一张图,直接切鱼眼、倾斜、正面俯拍、正面仰拍、全景俯拍、背面视角这些预设角度,本质上是在帮你做同一资产的镜头扩写。

做 AI 视频的人都知道,最烦的从来不是没灵感,是你明明已经有一张对的图了,还得为了补机位重新生成一轮。重新写提示词,重新抽卡,重新对角色一致性。如果一个平台能把这件事往前推一步,那它就不是在炫功能,它是在替你省返工的时间。对我们这种长期做角色和场景资产的人来说,多角度不是炫技,是效率工具。2. 九宫格拆分,适合把一个好画面继续榨干九宫格这部分,我觉得特别适合做细节镜头延展。先把一张已经不错的九宫格点击 9 宫格选择。

直接裁出来的图会糊,因为尺寸只有原图九分之一。接着再对单张裁剪结果重新生成,让模型去提取这一格里的动作和信息,最后把画面重新拉回到精细状态。

这个动作听起来有点绕,但真做过图的人会明白,它很适合补手部、饰品、背影、局部情绪这些镜头。

你不用从零再生成一张。你是从一个已经对的世界观里,继续往下扩。这就很关键了。因为 AI 视频最怕的就是补镜头的时候突然换了一个人,或者突然换了一个空间。3. 二十五宫格,已经有点分镜预演的味道了二十五宫格就更进一步了。它不只是裁切,更接近把一个复杂场景拆成一整组可继续生成的镜头单元。

你可以把它理解成一种轻量级分镜板。先把整体氛围、人物关系、动作状态放进去,再从里面挑出值得继续放大的那几格,往下做图,往下做视频。这个思路和我们平时做 AI 视频其实很像。先把大世界搭出来。再挑有效镜头。最后把有效镜头做细。很多时候,真正拉开效率差距的,不是模型多强,是你有没有办法把一个好结果持续复用下去。

它更像一个中间层,能把灵感和成片之间那段最乱的流程接起来。抄袭和创新的边界,到底该怎么看这个问题很难,但我这几年看产品看下来,心里有一个比较朴素的判断。创新很少从真空里长出来。几乎所有新产品,都会站在旧产品肩膀上。你看到一个好交互,一个好页面,一个好组织方式,拿来学习,本身就是产品迭代的一部分。真正让人反感的,往往有两种情况。第一种,学了表面,没学明白底层逻辑,结果只复制了一个空壳。第二种,明明吃的是别人验证过的路径,却连自己的理解和增量都不愿意给。我觉得判断边界,可以看三个问题:你有没有解决一个新的问题、你有没有把旧问题解得更顺、你有没有在关键链路上给出自己的判断。如果三个问题都答不上来,那大概率只是换了个 logo。如果你确实把人和 agent 的关系往前推了一步,把 skills 接进来了,把外部工具开放出来了,把工作流从人操作升级成了人指挥 agent,那这个产品就已经在往前走。哪怕它看起来还有熟悉的影子,市场也会慢慢给出自己的答案。创新从来都不靠一句我们和别人不一样。它靠的是用户真正用过之后,发现这玩意儿确实更丝滑了,更强了,更省了。我更关心的,是 AI 视频平台和人之间的关系正在变以前的软件交互,核心是点。点菜单,点按钮,点下一步。这几年开始变成聊天框加画布。人一边说,系统一边生成,一边改。再往后,我真觉得很多场景会收缩成一个更纯粹的对话框。画布不会消失,但它会退到第二层,变成 agent 的工作现场,不一定一直暴露给人看。人只负责表达目标。平台负责理解目标。agent 负责执行目标。这时候平台真正的核心资产,也会慢慢从前端页面转移到另一边。沉淀在 agent 里的经验。沉淀在 skills 里的方法。沉淀在工作流里的 know-how。这和传统互联网时代调 API 已经很像了。只是今天调用接口的角色,越来越多时候已经换成了 agent。最后LibTV 这波让我最有感觉的地方,从来都不是它像不像 TapNow。我更关心的是,AI 视频平台终于开始往下一个阶段走了。从工具,走向基础设施。从给人直接操作,走向给 agent 调用。从拼页面,走向拼 skills、拼模型、拼价格、拼交付结果。这条路接下来一定会越来越卷。也一定会越来越贵。但它会越来越接近真实生产。下一阶段真正决定胜负的,不是页面像不像。是你的 agent,能不能用更低的成本,把更复杂的视频任务稳定做完。感谢你看到最后。如果你想先把素材资产这一步做得更丝滑一点,我们这边也把一个免费的 Gemini 二十五宫格图片智能体 gem 封装好了。

它最适合拿来做剧情分镜图、角色关系图、连续动作图。你先用它把二十五宫格跑出来,再把图上传到 LibTV 里面继续裁剪、重绘、生成,整条链路会丝滑很多。

文末扫码添加好友,备注gem,就可以直接领取。如果你也在关注 AI 视频平台接下来会怎么变,欢迎把这篇文章转给做产品、做内容、做 agent 的朋友一起聊聊。

推荐阅读