iPhone 17 Pro 演示运行400B大模型,移动端AI要变天?

一段演示视频在Hacker News引发热议:iPhone 17 Pro 居然能运行 4000亿参数的AI大模型。

发生了什么?

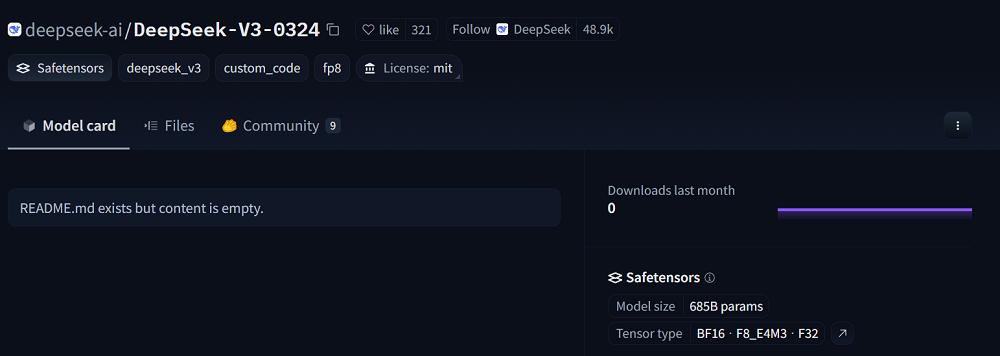

一位开发者展示了在 iPhone 17 Pro 上运行 400B 参数大模型的 Demo。虽然是 MoE(混合专家)模型,实际激活参数没那么多,但能在手机上跑起来本身就够离谱。

有评论直接追问: “这用的是 Apple 2023年那篇’LLM in a Flash’论文的技术吧?”

没错,就是那篇让业界沸腾的论文——通过 SSD 直接streaming 模型权重到 GPU,绕过内存限制。

为什么这么轰动?

以前:手机端跑个7B模型都费劲 现在400B直接上?哪怕是 MoE,实际激活参数也可能上百亿。

有网友追问:”那什么时候能跑到 100 tokens/second?”

这是个关键问题。如果手机端能流畅运行顶尖大模型,意味着:

背后技术藏着的趋势

-

端侧 AI 加速—— Apple 已经在芯片层面布局 NPU,配合论文技术突破

-

模型压缩成熟—— MoE、量化、剪枝技术让大模型”瘦身上车”

-

明年iPhone 17系列 可能会成为首款真正意义的”AI Phone”

当然,有资深玩家泼冷水:”演示归演示,日常使用又是另一回事。”,社区质疑:

-

生成速度仅为0.6个tokens/秒,这意味着生成一个单词约需1.5至2秒。

-

写在最后

移动端 AI 正在跨越一个临界点。从”能跑”到”跑得爽”,可能就是以后的方向。