你有没有这种感觉?

读了很多文章,存了很多PDF,记了很多笔记——但要用的时候,翻遍整个笔记库,想不起来自己记过什么。

这就是传统知识管理的困境:存了一大堆,用的时候找不到。

今年4月,AI大牛Andrej Karpathy(OpenAI创始成员、前特斯拉AI总监)分享了他的解决方案——LLM Wiki。方法一出,立刻在AI圈刷屏。

这篇文章,从原理到实操,手把手教你在Obsidian里搭一套自己的LLM Wiki。

一、为什么传统笔记会”死掉”?

先说清楚问题在哪,你才能理解这个方法为什么有效。

绝大多数人记笔记的方式是这样的:

- 读一篇文章,记几条笔记

- 再读一篇,再记几条

- ……

- 三个月后回来找,发现完全不知道当时在说什么

问题出在两个地方:

第一,笔记之间没有连接。每篇笔记是孤立的,两篇讲同一主题的文章,笔记却散落在不同角落,互相不知道对方存在。

第二,没有人来维护。笔记越记越多,结构越来越乱,最后变成一个没人愿意打开的数字垃圾桶。

LLM Wiki解决这两个问题的思路很简单:把维护工作交给AI,让人只做最重要的事——提问和思考。

二、LLM Wiki是什么?

LLM Wiki,字面意思是”用大语言模型来维护的维基百科”。

但它不是让你去写维基,而是把AI变成你的”第二大脑管理员”,帮你做这些事情:

- 把读过的资料整理成结构化文章

- 自动发现不同文章之间的联系

- 帮你回答”我记得看过一个观点但不知道在哪”的问题

- 定期检查知识库里有没有自相矛盾的地方

你可以理解为:LLM Wiki是一个会自动生长的知识库——你往里面放资料,它就越用越聪明,而不是越积越乱。

三、三层架构:raw、wiki、Schema

LLM Wiki的核心是一个简单的三层文件夹结构:

为什么这样设计?

把”原始资料”和”整理后的知识”分开是关键。

- raw/ 是你的”书架”,存放原始书籍报刊,不做任何批注

- wiki/ 是你的”记忆”,是AI帮你提炼出来的精华

- CLAUDE.md 是”工作指南”,定义AI的工作规则

四、四个核心操作:知识如何流转

LLM Wiki的运转靠四个操作,构成了一个完整的知识管理循环:

① INGEST:把资料”编译”进知识库

这是最核心的操作,也是最神奇的部分。

当你把一篇新文章放进raw/目录后,告诉AI:”请帮我处理这份资料。”

AI会做这些事情:

- 阅读原始文章,提取3-5个核心判断

- 写一篇结构化的摘要文章,放进wiki/

- 检查现有的10-15篇相关文章,标注哪些地方被这份新资料补充或推翻

- 更新index.md(全局索引),把新文章加进去

整个过程,你只需要”丢资料+确认”,剩下的全由AI完成。

② QUERY:向知识库提问

这是知识库的价值兑现。

你可以问:”我之前看过关于AI编程工具的文章,核心观点是什么?”

AI会:先读index.md找到相关页面,再深入阅读这些页面,整合信息,生成带引用的回答。

更重要的是:如果这个回答质量很高,可以让AI把它也写回wiki/,成为新的知识点。 这就是Karpathy说的”知识复利”——每次使用都在积累。

③ LINT:定期”体检”

这是LLM Wiki最独特的设计——AI会定期检查自己的健康状况。

每隔一段时间(比如一周),让AI跑一遍lint检查:

- 有没有自相矛盾的内容?

- 有没有被其他文章推翻但还没更新的旧观点?

- 有没有哪个概念被反复提到但没有独立页面?

- 有没有页面没有任何其他页面链接过来(”孤岛页面”)?

这些问题,人类很难坚持做,但AI可以一丝不苟地执行。

④ INDEX + LOG:索引与日志

index.md:相当于整本书的目录,每篇文章一行摘要。AI回答问题前先读它,快速定位相关知识——不需要向量数据库,中等规模下(100篇左右)这种方式反而更快更稳。

log.md:知识库的时间线日志,记录每次ingest和query的内容。只增不改,方便追溯。

五、与传统RAG相比,优势在哪?

可能有人听说过”AI知识库”的另一种做法——RAG(检索增强生成)。简单说就是:把文档扔进去,问问题时AI从里面检索相关内容来回答。

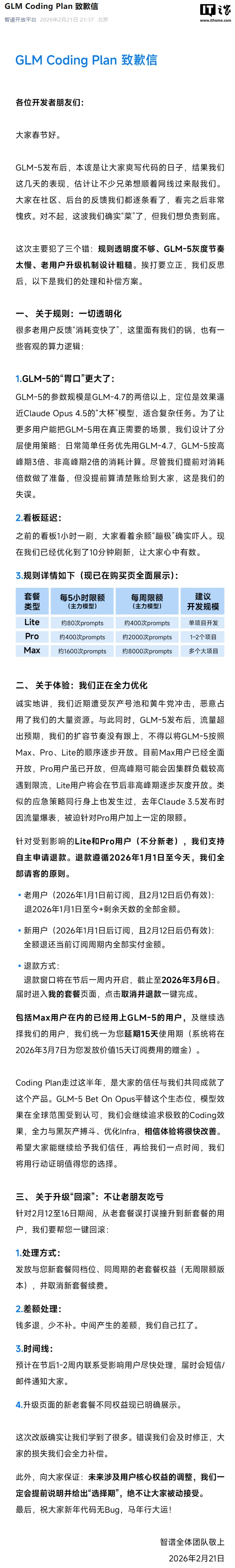

| 对比维度 | 传统RAG | LLM Wiki |

|---|---|---|

| 知识组织 | 散乱的文档片段 | 结构化、互链的知识网络 |

| 每次使用 | 从零检索,无积累 | 优质问答自动沉淀,越用越聪明 |

| 信息一致性 | 不同文档说法矛盾,无法发现 | lint检查自动发现矛盾 |

| 维护成本 | 高,人工整理文档 | 极低,AI自动维护 |

| 适用规模 | 大规模(靠向量检索) | 中等规模(100篇左右最合适) |

| 工具要求 | 向量数据库、Embedding模型 | Markdown文件 + AI Agent |

LLM Wiki不是要替代RAG,而是在个人知识管理这个场景下,用更简单的方式实现了更好的效果。

六、手把手实操:从零搭建你的LLM Wiki

第一步:准备工具

需要两样东西:

- Obsidian(免费):知识库浏览器,用来查看和管理Markdown文件

- Claude Code(或任意AI Agent):负责执行ingest、query、lint操作

Obsidian下载地址:obsidian.md

Claude Code安装:在命令行运行 npx @anthropic-ai/claude-code

第二步:建立文件夹结构

vault/├── raw/

│ ├── reports/ (放PDF报告) ├── clips/ (放网页剪藏) └── audio/ (放录音转写)├── wiki/

│ ├── concepts/ (概念页)

│ ├── insights/ (洞察页)

│ └── entities/ (实体页)├── index.md├── log.md└── CLAUDE.md

第三步:写好CLAUDE.md(这是灵魂)

CLAUDE.md是给AI的工作手册,定义它的行为规则。以下是一个入门版模板:

这是一个关于[你的领域]的个人知识库,

目标是构建一个持续累积、互相连接的知识网络。

## 目录结构

– raw/:原始资料(只读)

– wiki/concepts/:概念解释

– wiki/insights/:洞察与判断

– wiki/entities/:具体实体

## 编译规则(INGEST)

1. 阅读raw/中的新资料

2. 提炼3-5个核心判断(附数据支撑)

3. 生成一篇Markdown文章(含标题、标签、来源)

4. 检查wiki/中相关页面,更新矛盾或补充

5. 更新index.md和log.md

## 回答规则(QUERY)

1. 先读index.md定位相关页面

2. 整合多个页面的信息,给出带引用的回答

3. 如回答质量高,询问是否存入wiki/

## 维护规则(LINT)

每周末检查:

– wiki/中是否存在矛盾内容

– 是否有过时观点需要更新

– 是否有孤岛页面需要链接

– 是否有重要概念缺少独立页面

第四步:放入第一份资料,开始编译

把一篇你觉得有价值的文章PDF放进raw/reports/,然后对AI说:

看AI怎么处理,你会立刻理解这个系统的威力。

七、Obsidian的几个实用配置

搭好框架后,给Obsidian装几个插件,体验会好很多:

- Graph View(内置):可视化页面之间的关联,看哪些页面是核心节点,哪些是孤岛

- Marp插件:把Markdown一键转成幻灯片,知识库内容直接拿来演讲

- Dataview插件:用类SQL的方式查询你的知识库,比如”显示所有带AI标签的页面”

- 图片下载设置:在设置里把图片默认下载到raw/assets/,保证链接永久有效

八、效果到底怎么样?

已经有实践者分享了真实效果:

- 6份沉睡PDF(之前存了没看)→ 全部被编译成互链文章

- 30个零散文件 → 变成35篇互相引用的知识网络

- 40页PDF → 提炼成800字核心洞察,信息密度大幅提升

更重要的是:知识库的检索效率发生了质变——从”我好像存过这个”变成了”我知道在哪里能找到,而且能找到相关的全部上下文”。

九、给新手的建议

不要一上来就追求完美。从一份资料开始:

3.本月:迭代CLAUDE.md

🦐 最后一句话

知识管理最大的敌人不是工具,是没有系统。LLM Wiki的本质,是把”整理”这件烦人的事交给AI,让你只做两件事:输入和提问。剩下的,AI帮你编译、连接、更新、体检——你的知识会变成一个真正活的、越用越聪明的系统。

从今天起,不再让你的资料”死”在笔记里。