微星发布 DGX Station 系统 XpertStation WS300

开发者可以首先在该系统上运行和微调先进模型,并在此后无缝迁移到数据中心或云端的英伟达 Grace Blackwell Ultra 机架级系统。

亚马逊 CEO 安迪 · 贾西翻倍 AWS 营收长期预期:十年后有望达 6000 亿美元

安迪 · 贾西表示,企业已收到市场对人工智能非常明确且显著的需求信号,在实现盈利前需要大额提前投资。

机械革命推出全球首款搭载智谱 GLM-5-Turbo 模型的 OpenClaw 迷你主机

得益于该模型“针对 OpenClaw 场景深度优化”的属性,imini E300 可提供原生 AI Agent 终端体验,实现“龙虾”开箱即用。

英伟达深化与现代汽车集团合作,联手打造 L2 及以上辅助驾驶

英伟达还将与现代汽车旗下自动驾驶合资企业 Motional 探索扩大合作,进一步提升 L4 Robotaxi 的技术能力。

英伟达组建 AI 实验室联盟 Nemotron Coalition,共建开放前沿模型

Nemotron Coalition 联盟的创始成员包括 Cursor、Mistral、Perplexity、Thinking Machines Lab 等明星 AI 初创企业。

英伟达“桌面 AI 超算”DGX Spark 现已支持四机集群互联

即将发布的软件更新预计将进一步增强 DGX Spark 系统的编排和可管理性,实现更快的迭代和从原型到生产的更平滑过渡。

三星电子:HBM5 与 HBM5E 将分别升级基础裸片与 DRAM 的制程

换句话说,HBM5 将采用 2nm 基础裸片搭配 1c nm DRAM,HBM5E 则将是 2nm 基础裸片搭配 1d nm DRAM。

郭明錤:英伟达投资 Groq 推动 LPU AI 芯片出货实现数量级成长

英伟达预计将把单一 LPX 机柜 / 机架中的 LPU 数量从当前的 64 颗提升至 256 颗,新型 LPX 系统预计 2026Q4~2027Q1 量产。

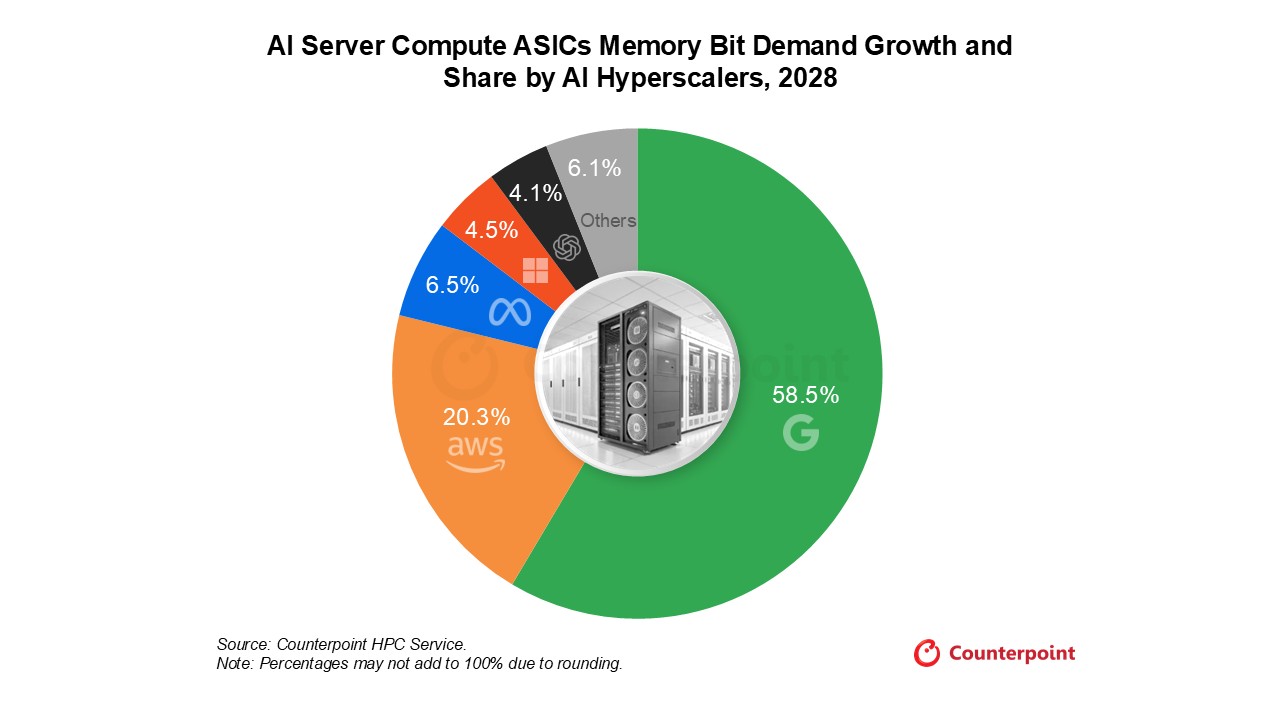

Counterpoint 预测:AI ASIC 对 HBM 内存需求四年猛增 35 倍

AI ASIC 阵营 HBM 需求的最重要推动者还是谷歌与其 TPU 芯片。HBM3E 仍将是 AI ASIC 阵营的主力高带宽内存品类。

亚马逊 AWS 将部署 Cerebras 晶圆级 AI 芯片 CS-3,与自家 Trainium 配套使用

推理预填充属于并行工作负载,要求大算力和适中的内存带宽;推理解码本质上是串行的,算力需求较小但内存带宽要求高。组合使用能发挥两款 AI 芯片各自的长处。