讲真的,测完以后心情有点复杂。有惊喜,也有遗憾。但最大的感受是:「DeepSeek 这波,格局不一样了。」当时 Wesight 的停更,一度让我很痛苦,我用 DeepSeek V4 进行了迭代,现在他是一个可以搭载你本地 Claude Code、Codex 迭代 Agent 了。

并新增 CC 和 Codex 引擎,配合原先的 Openclaw 引擎,现在 Wesight 是个多引擎驱动的成熟系统了,你只要安装 Wesight,其余的都一键配置好。

无论你的 Claude Code 配置的是什么模型,在 Wesight 中使用变得如此简单。

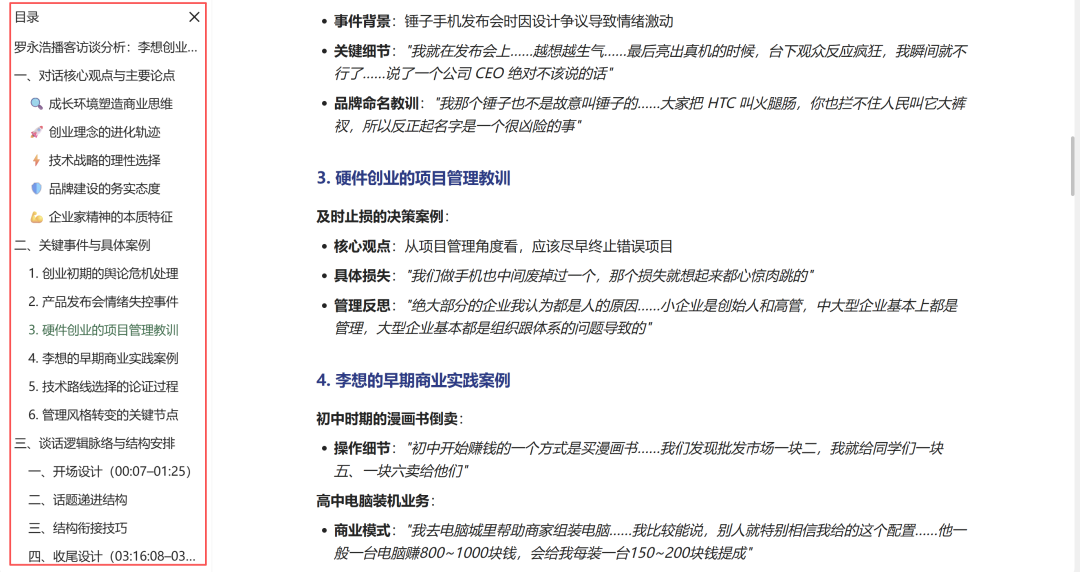

我让 Wesight 中的 Codex 给 DeepSeek V4 做了一次总结,大家可以先过目一下:

两个版本,定位很清晰V4 分了两个版本:「V4-Pro」:1.6T 总参数,49B 激活,1M 上下文。这是旗舰,对标顶级闭源模型。「V4-Flash」:284B 总参数,13B 激活,同样 1M 上下文。主打便宜和快。

我拿到 API 的第一件事,就是用长上下文测它的极限。毕竟 DeepSeek 这次最核心的一个变化,就是「1M 上下文直接变成标配」。以前 1M 上下文是高配、是噱头,很多模型标了但其实根本用不满。但 V4 不一样,它从底层架构就围绕长上下文设计。架构变化很大,不是小打小闹这次 V4 的架构改动,说实话挺激进的。先说注意力机制。V4 搞了个 Hybrid Attention,把 CSA(Compressed Sparse Attention)和 HCA(Heavily Compressed Attention)两种注意力层交错着用。一个管长距离依赖,一个管超长压缩。相当于给模型装了两套眼睛,近处看得清,远处也不模糊。

优化器也从 AdamW 换成了「Muon」,收敛更快更稳,再加上流形约束残差连接让参数调度更灵活,这波架构升级诚意很足。这些架构改动,我实测下来最直接的感受就是:「长文本的连贯性确实好了很多。」我喂了一个接近 90 万 token 的代码库进去,让它帮我做全局重构。V3.2 干到一半就开始忘事,变量名对不上,函数引用乱飞。V4-Pro 几乎全程在线,跨越几十万 token 还能记住我之前定的命名规范。Coding 能力,有进步我先是做了前端审美能力的测试,还是有显著的增强,比如这个一句简单提示词生成的个人博客网站。

重新优化了下 WeSight 的登录,也是科技感拉满。

先行者联盟群里的杨律师同样用 V4 做出来的应用,效果也还不错。

前端审美这块,V 4 确实比 V 3.2 强了不少。但说实话,之前用 GLM 5.1 搞 Wesight 的时候,出来的效果也挺能打,并没有拉开明显差距。不过说实话,Demo 和工程代码是两码事。前端页面一行提示词就能出效果。但 Wesight 涉及 Electron 构建、多引擎调度、Node 原生模块编译这些,模块间耦合度高,对模型的工程理解力要求完全不在一个量级。在这个场景下,V 4 开始有点兜不住了。比如下面这个构建报错:

在构建 electron 的时候,已经犯过的一次错还是会接着犯。

这里有个很明显的对比:同样是 Wesight 的 Electron 构建问题,GLM 5.1 基本一轮就能定位到根因,改了就不复发。V4 是改了犯、犯了改,同一个配置项反复横跳。这说明差距不在语法层面,在工程上下文的追踪深度上。

在 Wesight 的 Codex 面板,调试了好几次,也没修复这个 bug,始终无法回复,硬是楞在那里。

调试了好几次,也没修复这个 bug,始终无法回复,硬是楞在那里。我判断是 V 4 在遇到自己不熟悉的错误时,倾向于停止行动而非尝试替代方案,这在 Agent 场景下是个硬伤。还有个更头疼的:我发现此时长时任务跑到一半,它会自己停下。不是报错,也不是超时,就是单纯中断不继续了。你没法挂后台让它跑,只能在旁边盯着催。说实话,这在实际工程中有点难受。

最后没办法,我还是切换回 GLM 5.1 帮一次就解决好了。(毕竟刚整的 coding plan 还是很香的。)

处理好之后,去 Wesight 中使用就能看到 codex 正常回答了。

我看了下在 Code Arena 的测试中,DeepSeek V4 Pro 相较于 V3.2 进步很大,但还次于 GLM 5.1 和 Kimi K2.6。和我的测试结果相差不大。

如果你想要国产模型进行复杂的 Coding 任务,当下 DeepSeek V4 Pro 还无法达到领先的要求,相比较 GLM 5.1 的 Agent Coding 能力表现会更好些。价格方面,我本次测试任务一共花费近 50 吧,对比 Coding Plan 来说,还是贵了。毕竟我还没用 1 亿 token 呢。

Agent 能力,进步显著但还有坑DeepSeek 这次在 Agent 上下了不少功夫。官方直接说了:V4-Pro 已经是公司内部默认的编码模型了。内部评测反馈是,「体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式」。

这个评价不低。Sonnet 4.5 和 Opus 4.6 什么水平,大家心里都有数。我实测下来,用 V4-Pro + Claude Code 写代码,简单和中等难度的任务确实很流畅。代码生成的风格偏实战,不会过度设计,这在 Agentic Coding 场景下反而是优点。但有几个坑我也得说。第一个坑:「本地 skill 调用不灵敏」。我本地配了一些 skill 和 Cli,GLM-5.1、Kimi K 2.6 都能正常识别并调用,但 V4 有时候需要我明确提示才去调,不够主动。

我分析下来,V4 的问题不是不会调 skill,是「判断该不该调的决策不够果断」。同样一个 prompt,GLM 5.1 和 Kimi 2.6 能立刻识别出「这该用那个 tool 了」,V4 会犹豫,等你再 push 一下才动。第二个坑:「复杂约束下的理解力」。我给项目做了 spec 约束。比如提交 GitHub 前必须过一遍 commit 自检,这是 Wesight 开发规范里的硬要求。结果 V4 直接把自检跳过了,代码就往 GitHub 上推。说实话,这个 bug 比前面的构建报错更致命。构建报错至少你能看到,修就行了。但偷偷跳过约束,你要是不盯着完全不知道它漏了哪一步。这在团队协作场景里基本是一票否决级的风险。同样一份 spec 丢给 GLM 5.1,按 checklist 一步不落走完才提交,稳得一匹。这些场景在实际工程中挺常见的。V4 在这些地方的表现,跟 Opus 4.6 还是有一定差距。不过话说回来,这毕竟是预览版。DeepSeek 也坦诚说了,和 Opus 4.6 思考模式存在差距。这种诚实我反而挺认可的。推理和知识,可圈可点推理这块,V4-Pro 在数学、STEM、竞赛型代码上,超越了所有已公开评测的开源模型,跟世界顶级闭源模型打平。世界知识更是猛。在知识评测中大幅领先其他开源模型,只比 Gemini 3.1 Pro 稍逊一丢丢。我用一些非常冷门的领域知识去测,比如某些小众编程语言的特性、特定年份的学术论文细节,V4-Pro 的准确率明显比 V3.2 高了一个档次。比如这个经典的洗车问题,V4-Pro 的回答如下:

还有杨律师的这个 demo,粒子的分布、运动,ds 是用数学运算搞的,推理能力不错。

但有一个点要注意:V4 目前「还不是多模态模型」。纯文本。虽然有传言说内部已经做了多模态相关工作,但官方明确表示暂时不会放出来,可能得等到 V4.5 或者 V5.0。写作能力,风格化不错我发现基于 DeepSeek V4 强大的上下文,配合 Obsidian 知识库,用来写作,效果也还不错。甚至,这类的文章都不需要 Rag 了,他学习语言风格学的很不错。和 Claude Opus 4.6 有一点点差距,但是好过 4.7 的。如果你给的素材足够丰富,他的仿写风格味道越对味。

价格,涨了但依然良心

相比 V3 确实涨了。但反过来想,V4-Pro 参数量 1.6T,是 V3.2 的将近两倍半。参数大了,能力上去了,价格涨一点也合理。横向对比海外:Claude Opus 4.7 输入、输出25,GPT-5.5 输入、输出30。国产模型整体依然便宜「60%」左右。而且这个价格还有下行空间。据透露,下半年华为昇腾 950 超节点批量上市后,V4-Pro 的定价预计会大幅下调。所以现在这个价格,更像是「产能不够,先用价格控一下流量」。最让我感慨的,是国产化的决心读 V4 的技术报告,我发现一个细节。他们引入了「MXFP4」,在后训练和推理体系里用上了。这意味着可以适配国产卡,华为昇腾、寒武纪、壁仞都能跑,降低对 NVIDIA FP8 生态的绑定。还有「TileLang」。底层 kernel 不再完全靠 CUDA 写,而是用更高层级的 DSL 描述计算,再编译到不同硬件上。迁移成本大大降低。「MegaMoE」融合内核也是专门为减少专家并行通信等待设计的,已经在华为昇腾上跑通了。这些操作,说白了就不是单纯为了刷榜。是奔着让模型能在国产硬件上真正用起来去的。你可以说 V4 在 Agent 上还有 bug,可以说它没有多模态有点遗憾。但你不得不承认,「在 AI 国产化这条路上,DeepSeek 走得比谁都扎实。」总结一下DeepSeek V4 不是一个让你「卧槽牛逼」的模型。没有碾压式的领先,没有革命性的新功能。但它是一个让我「嗯,方向对了」的模型。1M 上下文标配、Agent 能力大幅提升、推理和知识逼近顶级闭源、底层架构全面拥抱国产化。每一点都在为未来铺路。我给 V4 的一句话评价:「V3 是 DeepSeek 的成人礼,V4 是 DeepSeek 的宣言书。」4 千万 token 测下来,我觉得值。最后说一句大实话:如果你主攻复杂工程开发、重度依赖 Agent Coding,现阶段要用国产模型的话, GLM 5.1 还是更稳的选择。但如果你做长文本分析、知识问答、风格化写作,V4 绝对值得一试。你试了 DeepSeek V4 吗?感觉跟 V3 比提升大不大?评论区聊聊。

以上,我是苍何。如果觉得有用,点个「赞」和「在看」支持一下。也可以转发给在用 DeepSeek 的朋友,看看他们的体验跟你一不一样。参考资料:1、DeepSeek-V4 官方发文:

https://mp.weixin.qq.com/s/8bxXqS2R8Fx5-1TLDBiEDg?scene=1&click_id=92、DeepSeek-V4 技术报告 PDF

https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/blob/main/DeepSeek_V4.pdf3、赛博禅心公众号:

https://mp.weixin.qq.com/s/mjaBklBlAhUF4AXvVgMo1A4、卡兹克公众号:

https://mp.weixin.qq.com/s/HBh2sRbJwDPB1L0lZ6nzHg5、DeepSeek API 文档:

https://api-docs.deepseek.com/zh-cn/guides/coding_agents