本来以为,混元这次会直接放个大的。比方说原生多模态,再比如一个超大参数模型,结果端出来的是Hy3 preview。一个快慢思考融合的混合专家模型,总参数 295B,激活参数 21B,最大 256K 上下文。怎么说呢,第一眼看上去,就不像一个来炸场的模型,甚至参数有点克制,他们自己也在指标上大方承认了是有差距的,不是那种刷榜后看上去效果嘎嘎好,结果一上手就打脸的那种。

Hy3 preview vs Hy2 vs Gemini 3.1 Pro vs GLM-5 vs Kimi-K2.5 vs GPT 5.4 xhigh

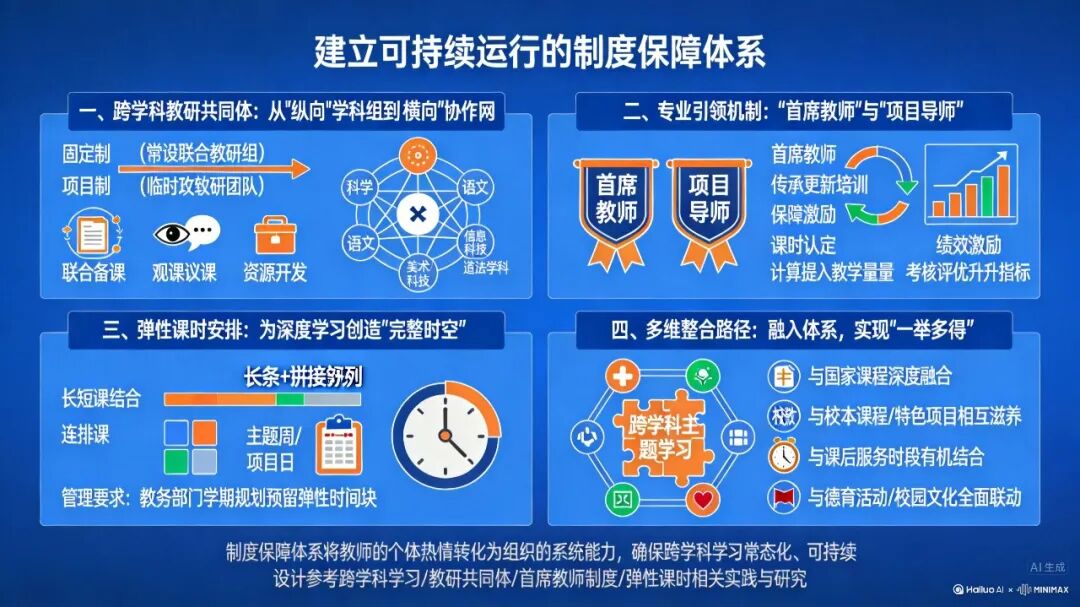

左:同一系列的模型在去年11月份到今年4月份在四个榜单上的分数提升,右:Agent综合能力测评,参数越小越往左,分数越高越往上,也就是说越往左上角的性价比越高。这几天我看完它的发布资料,又在WorkBuddy上测试了编程,Agent和文案,测完反而是会期待正式版更新的。Hy3 preview是一个完完全全重新整理过底层逻辑的模型,是一个想被塞进元宝,ima,CodeBuddy,WorkBuddy 这些真实产品里的模型。这个定位差别挺大的,榜单上加减几分体感其实没那么强。现在模型越来越多,便宜的小模型能力也上来了,我真正关心的是模型能不能稳稳接住自己。就像我今天要测的,不是让它写一首诗,或者问它几个知识题。我更想把它放进WorkBuddy里,看它在真实场景下能不能跑起来,把长文变成小册子,做批量化信息搜索的时候能不能给出每条信息的出处和补充,网页设计能不能一轮跑通能不能保留品牌调性,修bug的时候会不会一上来就大重构。

第一组,我想先测一个好朋友@阿真做的写书Skill,把Hermes Agent使用教程写成一本书。这很适合测长上下文。因为它不是简单总结。总结谁都会,压成 300 字谁都能压。但把联网搜索结果改成一本能读得过去的书,就要看它是不是真的理解了主线,顺序和前后层次了。

这组结果基本符合我对这个skill的预期。它没有把Hermes手册粗暴压成几段摘要,确实是做了一份可以翻的本地PDF。我比较喜欢的一点是,它会把观点,代码,注意事项用不同颜色区分出来,确实是可以照着它一步步把Hermes装起来。版本号,命令,配置点都放在里面,作为一份入门 Wiki,它是能用的。很多模型做长文整理,会把原文拆成四五块,然后每块都用差不多的句式写一遍。读者看起来很工整,但没有阅读欲。

BTW,在OpenRouter上Hy3 preview还免费到5月8号。。。🔗 openrouter.ai/tencent/hy3-preview:free来到第二组,

把长文变成学习手册和测试题。教学设计这东西挺能测模型脑子的。它要知道哪些概念是核心,哪些理解误区容易发生,题目能不能从原文里找到依据。

Hy3实现了我的几个硬性需求,模块,题目数量,自检表,题目解析也基本能回到原文里找资料依据。第三组,我想测一个更常见的网页设计,这是我最希望能有个踩着七彩祥云的模型来取代Claude的能力了。还是让Hy3把Claude Design的系统提示语做成Skill,然后做一个HTML版的网页3D小游戏。

这组是我觉得最有可能翻车的,3D小游戏很容易出现代码看着很完整,打开以后再白屏的。结果比我预期稳,我大概就跟它来回聊了四五轮,差不多半小时,就能跑起来,没有额外环境依赖,跳跃,收集,结算这些动作也都能做出来。第四组,照样的奔着取代Claude去的,GPT5.5也认了自己做在线研究的时候没有Opus 4.7好。所以我让WorkBuddy去整理 Hy3 preview 的资料卡,看它能不能区分信息来源。

这一组我是比较满意的。它没有只给一堆看起来很像资料的废话,而是把发布时间,模型规格,姚顺雨背景,价格入口这些东西拆得比较清楚。点开它给的链接,我也能找到对应网页。我们前面聊到的 API 价格、模型优化和背景信息,很多就是从这份资料卡里顺出来的。最后一组来测测人感。这其实是一个很抽象的标准。像 Claude Opus 4.7 因为过度优化代码能力,所以风格变回了那种稳稳接住你的 style。而GPT 5.5升级后又把自己掰回来了,就像玩跷跷板一样。模型没人感不是不会回答,而是太像客服了。你说你焦虑,它说我懂你。你说你被老板骂了,它说你已经很棒了。你说你最近累,它说请允许自己休息。反正越聊越觉得在浪费自己的时间。

人感这组,我第一眼其实是不满意的。Hy3的回答也不是说完全不能用吧,但还是有一点模型装人的味道。但我后来把同样的问题丢给 GPT 5.4,对比了一下,心情更复杂了。

Hy3 preview在这块要是能再往前走一步,那它放进元宝,ima这种高频做知识问题的入口,就会很加分。这一大轮测试完后,我现在可以给出我的答案了,Hy3 preview不是现阶段最强的,但它能独立放进一套真实工作流里了。它不是一个完美答案。它更像一个重新开局。预训练,重建。强化学习,重建。基础设施,重建。产品反馈,重新放回模型中心。所以我不想说混元已经赶超第一梯队了。这话现在说太早。我更愿意说,它重新获得了被认真测试的资格。接下来就看正式版,看更大的模型,看它在元宝,ima,WorkBuddy这些早就铺开的真实产品里,能不能继续被用户捶打,继续成长出来。我们到年底正式版再探再看。