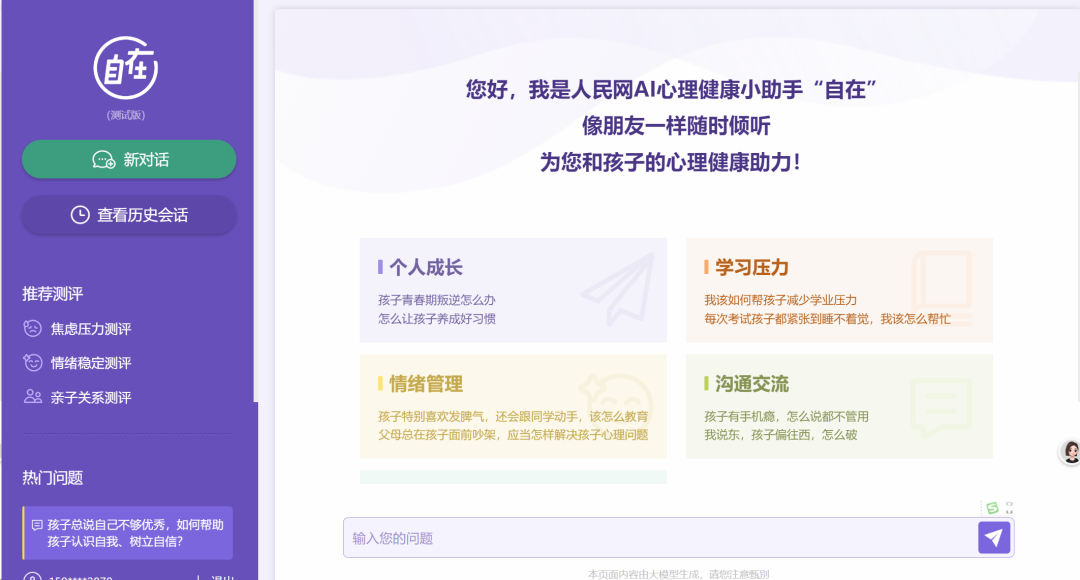

Suno v5模型出来有一段时间了,我们这一个多月也运用在了日常的创作、商单当中。效果相较之前的模型,可谓有了质的飞跃,它将AI音乐生成的质量和可控性提升至接近专业录音室的水平。官方宣称Suno v5是世界上优秀的音乐模型。

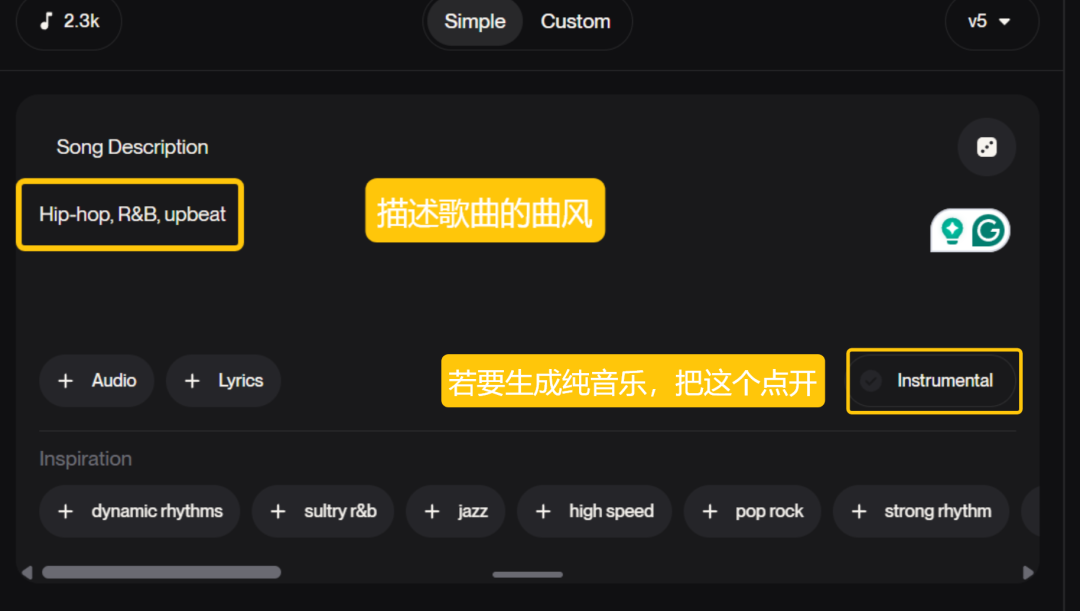

最显著的进步体现在音频质量达到了高保真的录音室级别,生成的音乐清晰度、响度和空间感大幅增强,特别是人声部分基本消除了以往令人诟病的“机械感”,演唱时的发音、咬字乃至情感起伏和呼吸细节都极为接近真人。在创作控制方面,v5模型对用户文本指令的理解和执行能力变得高度可靠,指定歌曲时长的成功率高达90%,使用户能从“随机生成”转向“精准控制”。总体而言,Suno V5极大地降低了专业品质音乐创作的门槛,但其在极端复杂场景下的表现和深度编辑能力仍有提升空间。网站链接🔗:https://suno.com/使用起来也非常方便。如果不指定歌词的话,则直接选择Simple模式,在歌曲描述那里输入提示词来描述歌曲的曲风。

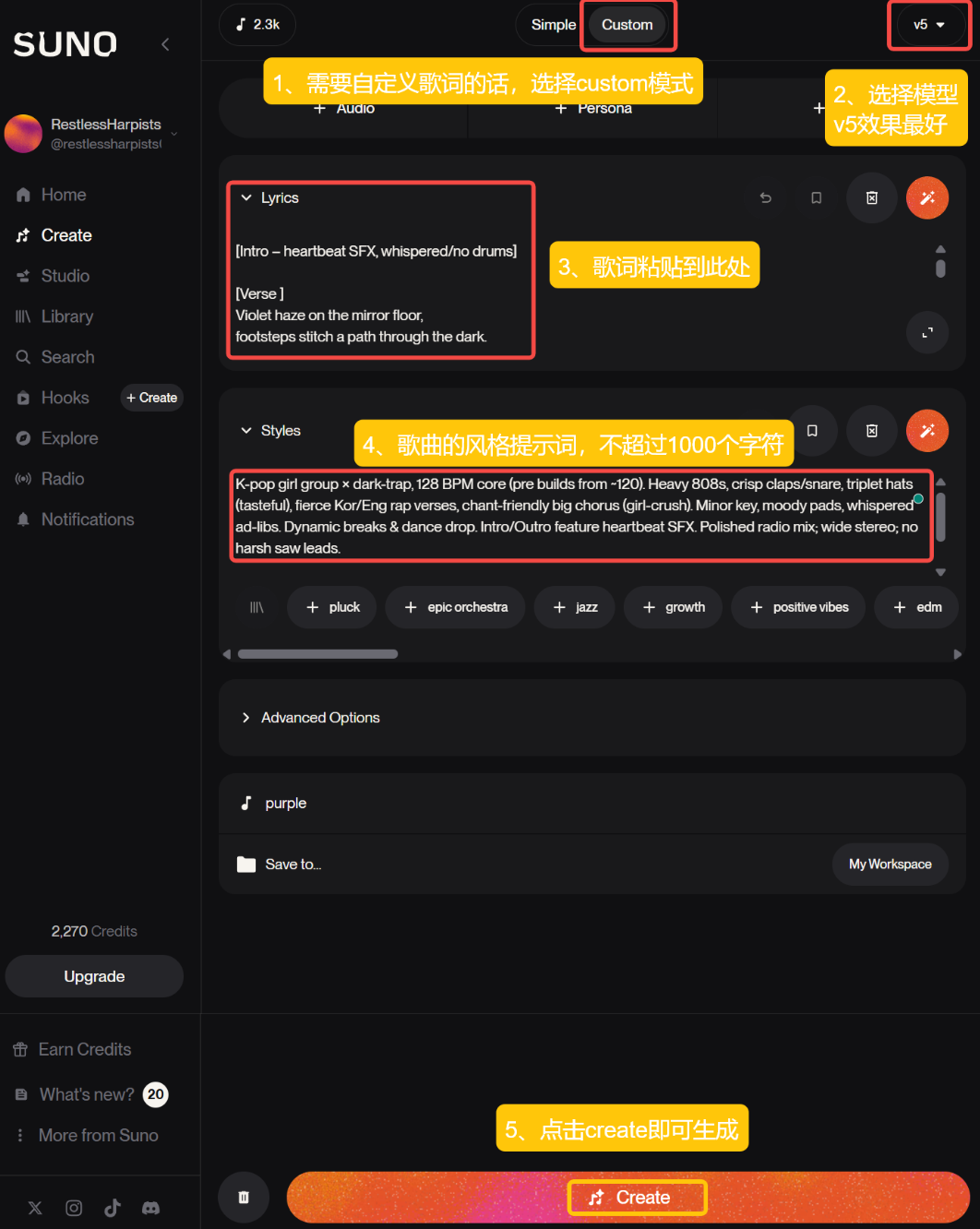

如果想要精确控制,自定义歌词,则选择Custom模式。基本的使用方法如下图所示:同样非常简单,选择v5模型,输入歌词、曲风,再点生成就行。高级设置那里我们后面会结合具体案例来介绍。

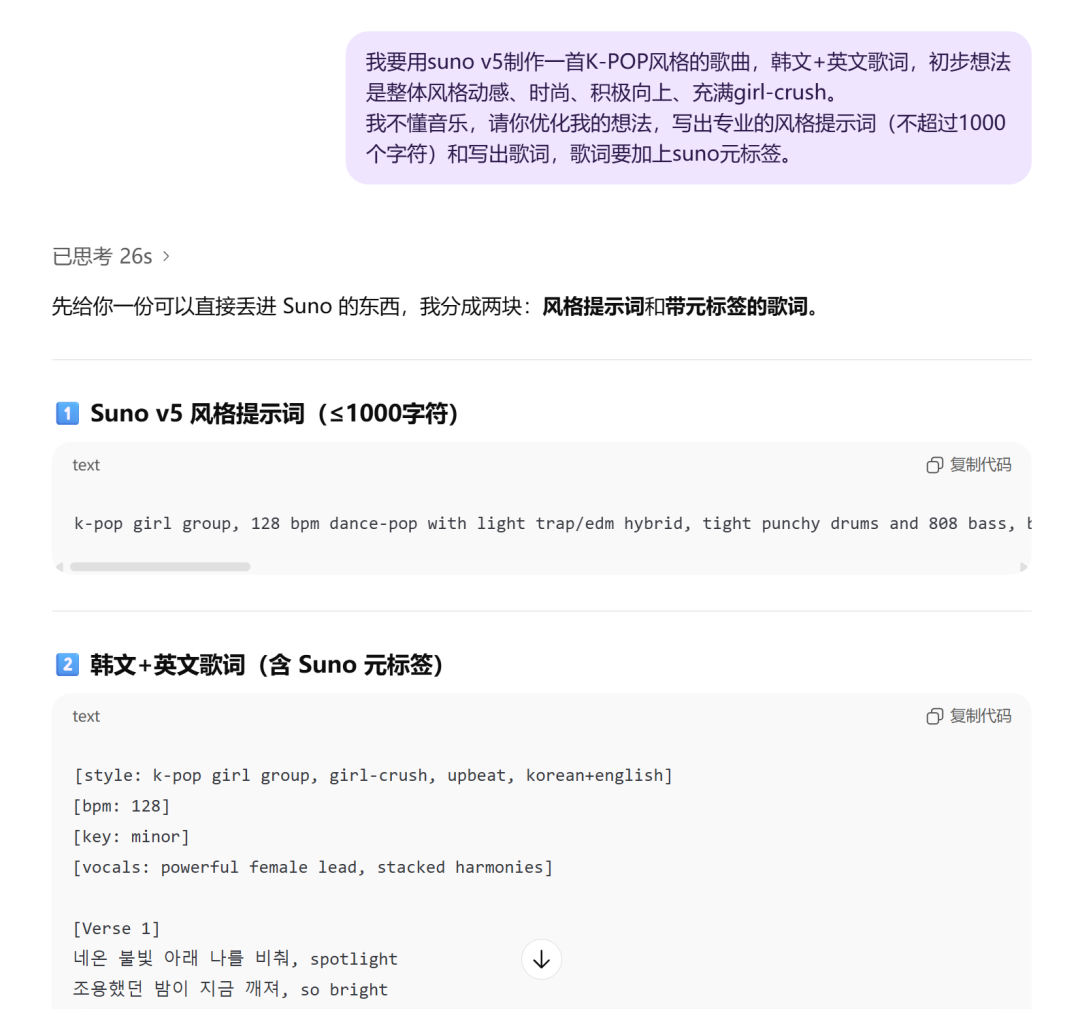

歌词可以写英文、中文或者其他语言都可以,但要用元标签进行说明。元标签是歌词中的歌曲说明。用方括号的形式将它们与应该唱的词分开。例如[intro]、[verse]、[chorus]、[bridge]等,则代表着[前奏]、[主歌]、[副歌]、[桥]。元标签内最好用英文来写。如果不懂任何乐理、也不熟悉那些英文曲风怎么办?AI的时代不需要你懂这些东西,只需要你懂如何提需求。网络上有一大堆复杂的结构化提示词模板,其实完全不需要那么复杂。大家可以参考如下方式向AI提问即可:

我要用Suno V5制作一首歌,中文/英文/日文,初步想法是XXX 我不懂音乐,请你优化我的想法,写出专业的风格提示词(不超过1000个字符)和歌词,歌词要加上suno元标签。

可以看到AI马上就把专业的曲风提示词、歌词都写好了,直接复制使用即可。如果对歌词不满意,或者经过测试觉得还想优化曲风,可以继续跟AI提需求。下面我们来给大家展示一下测试效果和一些进阶用法。K-pop我们通过前面演示的方式,生成了一首很好听的K-pop风格的女团歌曲。小编听着十分有画面感,为了更好地呈现,于是制作了一个简短的一分钟MV供大家欣赏,其中也运用了一些可灵数字人对口型和海螺2.3的跳舞功能。如果大家感兴趣,后面也会抽时间给大家拆解制作步骤。

由于篇幅的原因,后续测试我仅列出风格词,歌词就不再展示,与 AI 沟通的方式和前面保持一致即可。Pop rockStyles:

pop rock, 120 bpm, crisp electric guitars, driving live drums, anthemic chorus, male lead, radio-friendly, wide mix, modern alt-pop edge

小编其实挺喜欢OneRepublic、Maroon 5这类乐队,他们的音乐偏向于流行摇滚风格,旋律十分抓耳,副歌部分极具感染力,特别适合大合唱。

Styles:

anime j-rock, 150 bpm, bright guitars, driving live drums, soaring chorus, shōnen energy, band mix, minimal synths, emotional lift

对于日漫歌曲同样拿捏得很好。这首Suno生成的《蒼い翼で》完全抓住了J-Rock和热血动漫歌曲的精髓,节奏超燃,旋律也非常抓耳。如果不提醒,我真的还以为是哪部新番的OP。

Alt-popStyles:

dark alt-pop, minimal electropop, 88 bpm, minor key, whispery female vocal, close-mic, sub-bass 808, sparse trap hats, detuned synths, eerie foley, stutter dynamics, widened chorus, layered harmonies

相信许多朋友都喜欢碧梨,那种另类+电子+带一点暗黑的曲风简直让人上头。这首《Quiet Code》营造出了一种超级贴耳、近乎ASMR的私密感。这种慵懒又带点脆弱的氛围,真的太适合深夜emo或是一个人放空的时候听了。

华语情歌Styles:

mandopop ballad, 78 bpm, piano & strings, emotional male vocal, warm mix, lush harmonies, wide chorus, intimate verses, contemporary C-pop, cinematic reverb

当然,Suno V5 在对中文歌曲的适配程度上,相比之前的模型有了巨大进步。以华语芭乐来做演示。这首《点亮你的光》中文咬字非常清晰且自然,编曲很细腻,唱法也充满了“叙事感”,非常适合作为电视剧的插曲(OST),音色甚至还有点胡夏的感觉,很清亮。

旋律说唱Styles:

pop-rap, 100 bpm, melodic hook, light 808s, bright keys, male vocal + rap, catchy chorus, radio-friendly, clean mix, modern C-pop vibe

对于说唱,小编很喜欢听一些节奏感和旋律感并存的作品。《一路发烫》这首歌前奏就很有都市流行的那种强节奏感,让我瞬间想到了早年听的黑眼豆豆的一些歌,副歌也融合Hip-Hop和R&B元素。甚至中文说唱的咬字还有点像王以太。整体听感很chill、很自信。

进阶玩法-翻唱相信大家应该在很多平台上都刷到过各类AI翻唱或者改编,例如用陶喆的风格来翻唱周杰伦的歌曲等。这类账号的流量还不小。

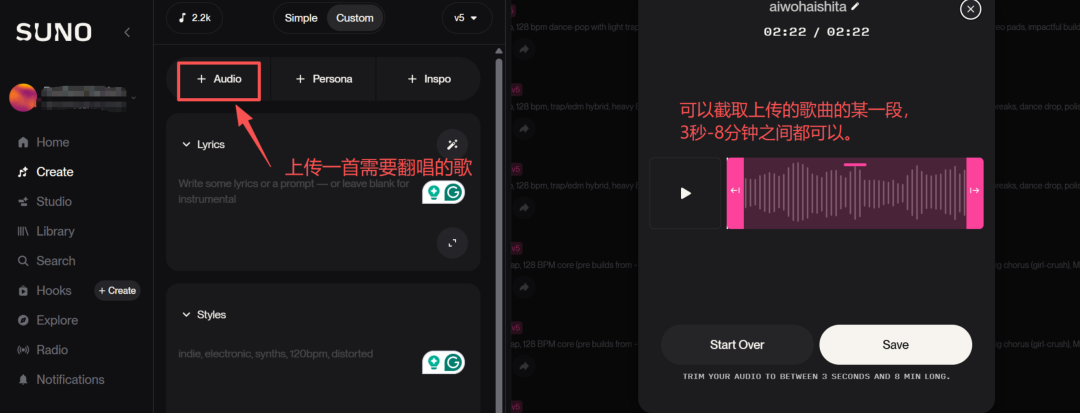

这些玩法在Suno中都是可以实现的。在Custom模式下,先上传一首需要翻唱的歌。然后可以截取想要Suno参考的那一段歌曲,也可以不截取,只需要音频在3秒至8分钟之内,再点击保存即可。

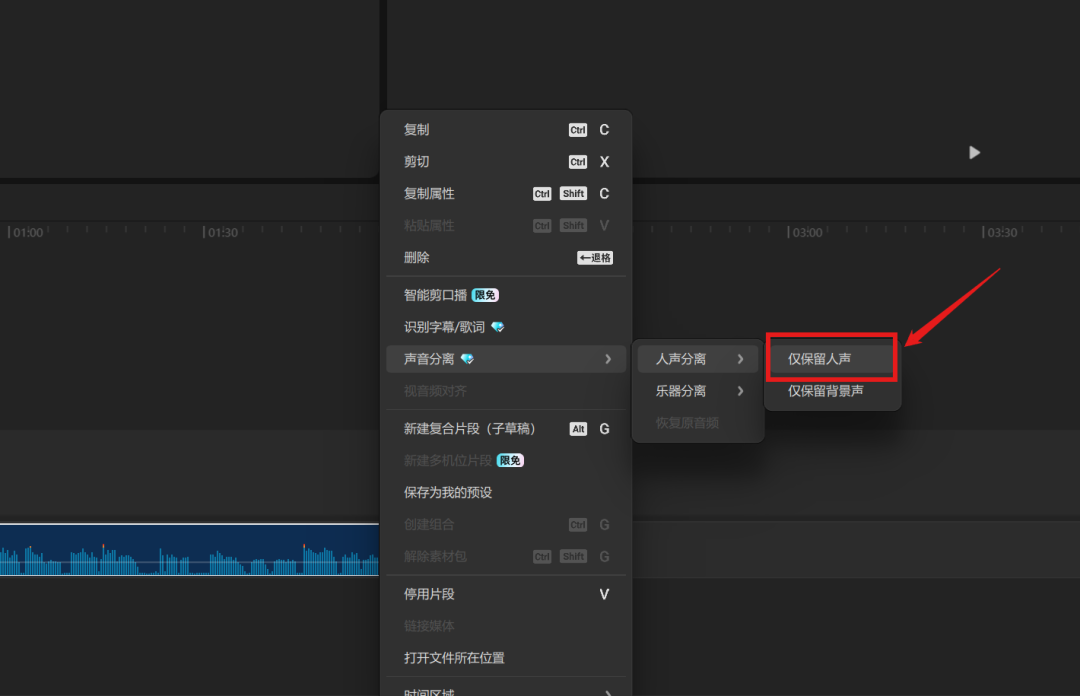

但对于许多已发行的歌曲,由于版权审核机制,很可能会显示上传失败。这个时候我们可以采取两种办法:1、最简单的办法,就是将歌曲用剪映处理一下。导入到剪映中,直接右击,声音分离,人声分离。如果是为了翻唱,我们就选择“仅保留人声”。这样处理之后,伴奏就被去除了,然后再导出.mp3格式的音频文件,再次上传到suno当中基本上就没问题了。

2、唱歌不跑调的朋友,也可以自己拿手机清唱一段,录下来。其实不需要你唱得有多好,只需要大致都在调上即可,反正咱们只是为了让suno参考一下,总体还是要作改编的。小编特别喜欢方大同,这里就哼了一段他的《因为你》。为了跟后面的翻唱作对比,也放了上来。唱不出他的感觉,请粉丝轻喷。

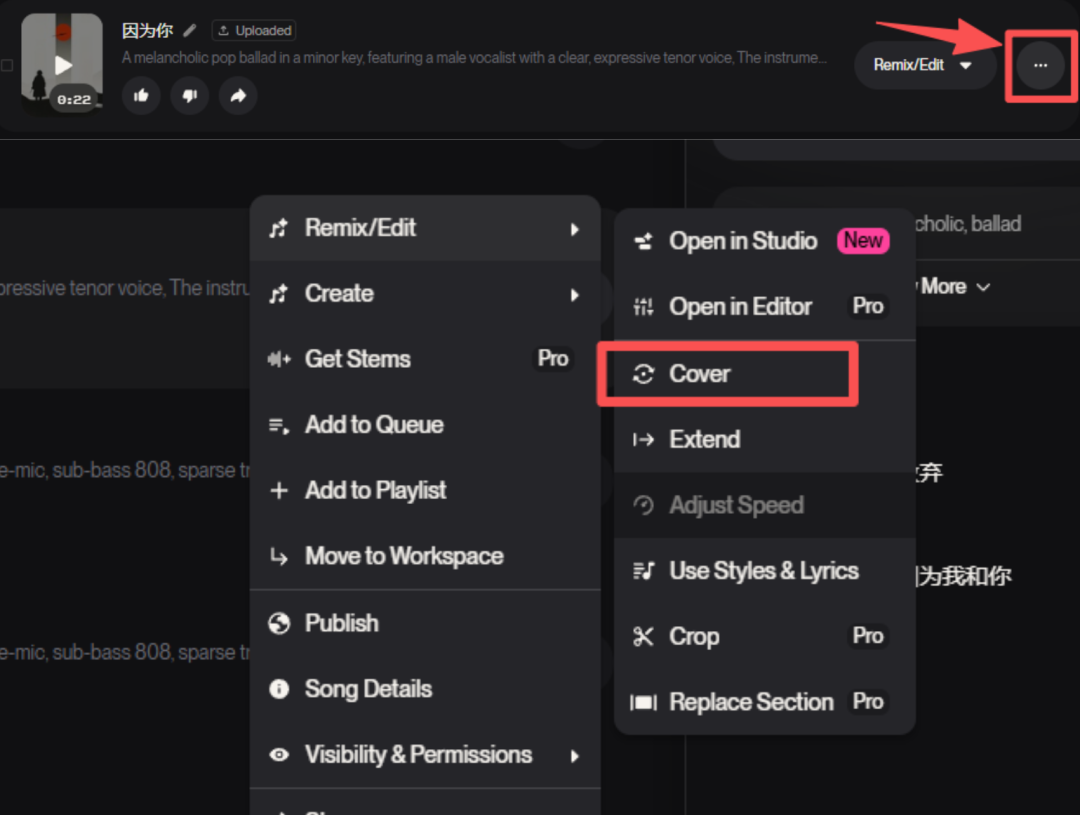

上传之后,我们在歌曲列表里找到它,点击右边的三个点按钮,在第一个Remix/Edit中可以看到许多选项,可以对任何你上传的歌曲、生成的歌曲进行裁切、编辑等功能,也可以进行改编。Cover就是翻唱,Extend是延长歌曲,Use Styles & Lyrics代表使用这首歌现有的歌词和曲风。根据需要选择即可,我们这里就选择Cover。

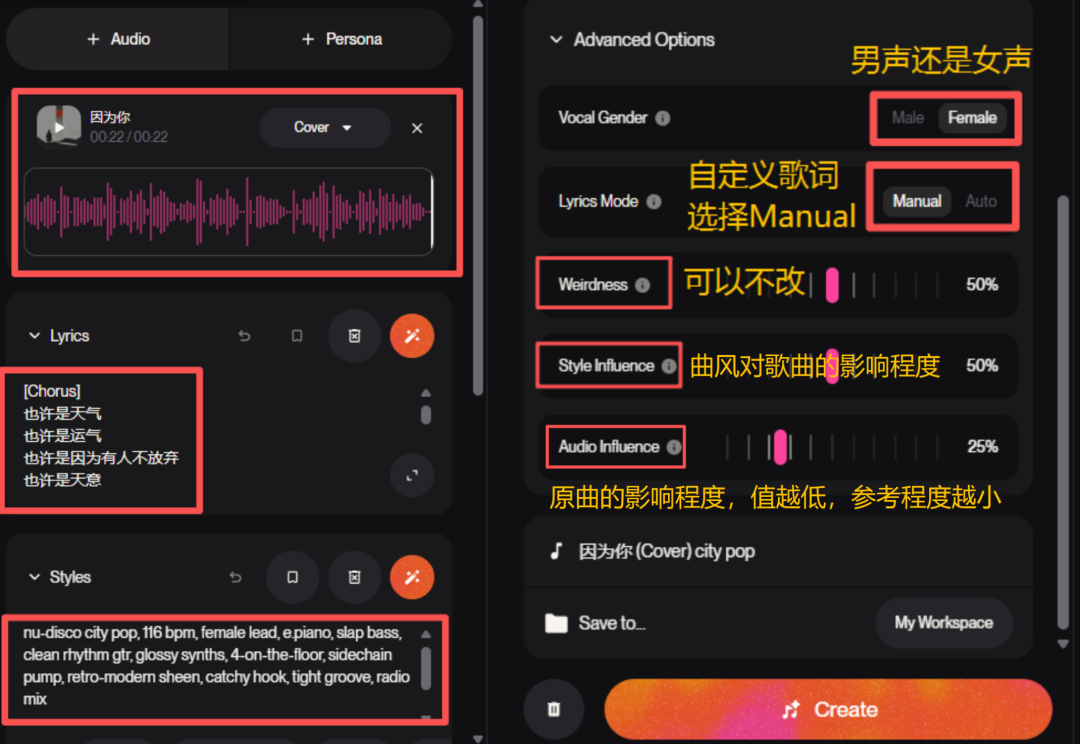

点击Cover后,在界面的左侧会出现上图中的信息,如果不想改编原歌曲的歌词,就依旧把相同的歌词填入,在下方的Styles那里填入曲风提示词。提示词撰写的方法就按照我们前面说的那样去问AI。我想把这首歌完全颠覆一下,改编成Citypop的风格,于是风格提示词填入:

nu-disco city pop, 116 bpm, female lead, e.piano, slap bass, clean rhythm gtr, glossy synths, 4-on-the-floor, sidechain pump, retro-modern sheen, catchy hook, tight groove, radio mix

Advanced Options高级选项中还有一些参数设置。Vocal Gender可以设定为男声还是女声,这里我把vocal设为女声Female。Lyrics Mode这里表示翻唱歌曲的歌词是自动生成还是人工设定,这里我们选择人工Manual。Weirdness的值越高,风格会更出乎意料,对于音乐人探索风格来说是很好用的参数,但对我们一般用户来讲,可以保持它默认的50%不变。Style Influence表示你前面输入的风格提示词对歌曲的影响程度,可以先保持默认,等听到不同结果后再进行微调。Audio Influence代表着原曲的影响程度,其数值越高,生成内容就越贴近原曲;数值越低,AI进行二次创作的空间也就越大。

这个可根据需求来设置,例如有人上传了自己的哼唱,想尽量不改变自己的声音,仅加一些伴奏或等,那这个值可以设置高一点。我这里就设为25%。大家听听最后生成的效果:

City Pop的味道很正,瞬间就营造出了那种既时髦又带点微醺的都市夜游感。接着改成Boom-Bap试试:

boom-bap, 92 bpm, dusty drums, chopped jazz sample, swing groove, warm tape, male rap, conscious bars, catchy hook, minimal fx, crisp snare

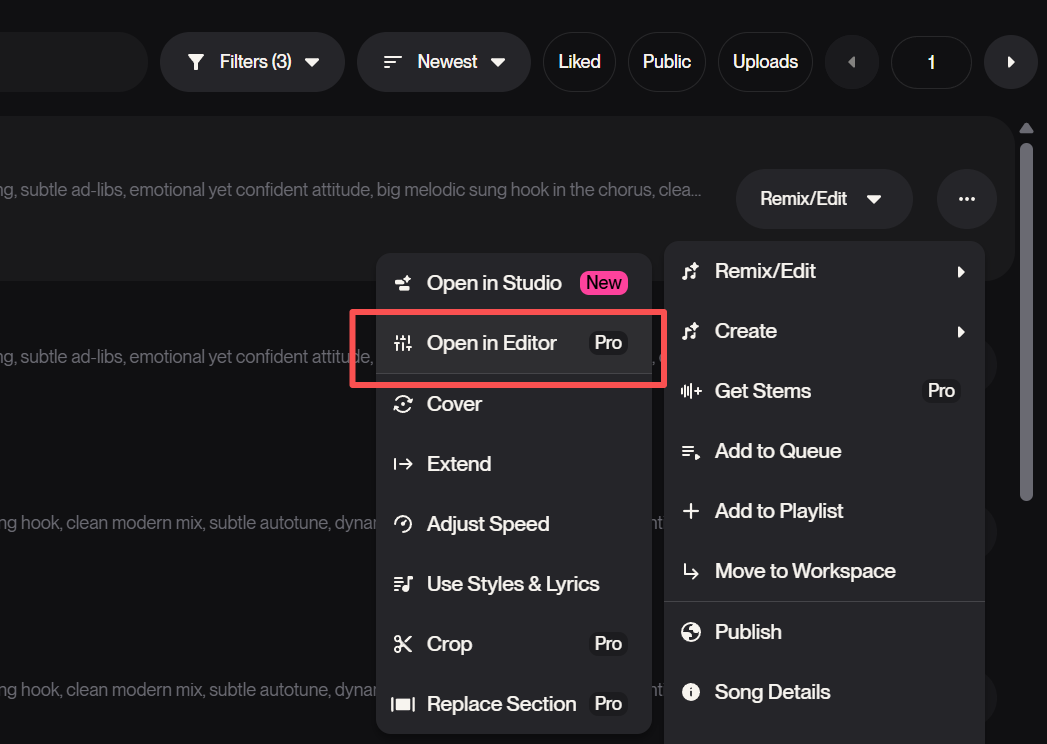

听感同样非常不错,它用了非常经典的鼓点,搭配慵懒的旋律,那段Rap让整首歌的氛围变得非常chill、非常放松,特别适合在街头漫步时听。除此之外,Suno还更新了Editor功能(仅限pro用户)。不论是你上传的歌,还是生成的歌,都可以点击右边的Open in Editor。

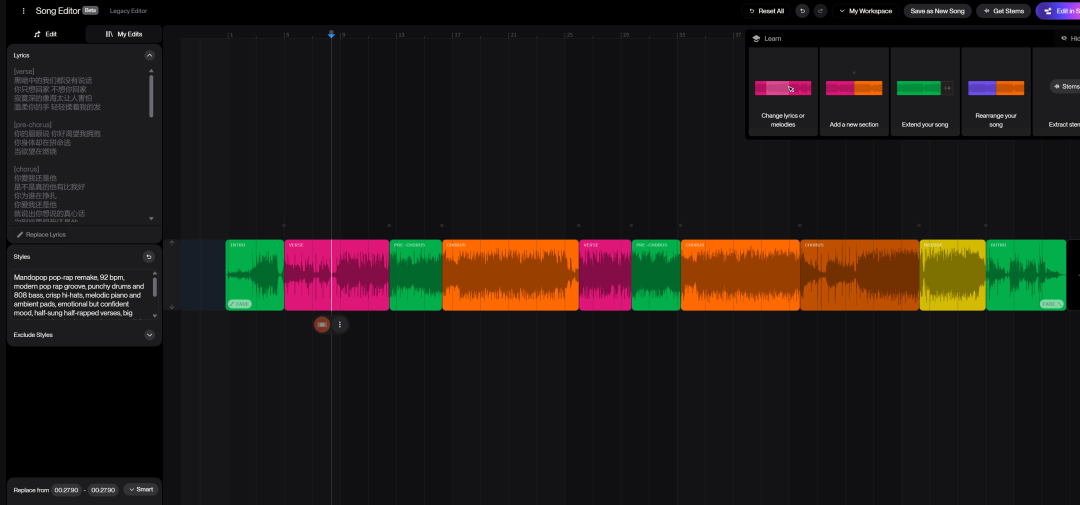

稍等待一会后,进入editor界面,可以看到它把你左边的歌词按照歌曲结果拆分成了前奏、主歌、副歌、桥段等等,与右边不同颜色的音轨都一一对应。有非常多的功能,操作起来非常简单,界面右上角的学习演示已经展现得十分直观了。

例如我们只需要在左边选中任何想要修改的歌词段落,可以替换歌词,也可以在右边点击修改并重新生成旋律。

还有许多功能例如增加片段、延长歌曲、重新编排等,大家感兴趣的可以自己去玩玩,使用起来非常简单,这里就不演示了。写在最后Suno V5让“做一首像样的歌”这件事,第一次离普通人这么近。门槛被工具拉低了,但天花板从来只取决于我们的审美、判断和表达欲,而不是模型的版本号。在日常的定制化 AI 视频项目里,这一点会被放大得格外明显。一条品牌片、一次活动宣传、一个课程预告、甚至是一支 AIGC 短片,配乐永远不是“随便来一首好听的歌”这么简单,而是要:跟镜头节奏对上拍子、跟文案情绪同一温度、跟客户的品牌气质站在同一边。音乐模型越来越强,但要从一堆“能听”的 demo 里,筛出一首真正“有品味、合调性、客户也点头”的歌,中间依然需要大量实践和学习。AI 工具负责打碎技术壁垒,让更多人有资格坐到“音乐总监”的位置上;而补上审美、叙事和专业知识这一课,是每个创作者自己的长期修行。也许几年之后,没人会在意这首歌是人写的,还是模型写的。他们只会记得:这段音乐,在那个画面里,很对。

推荐阅读