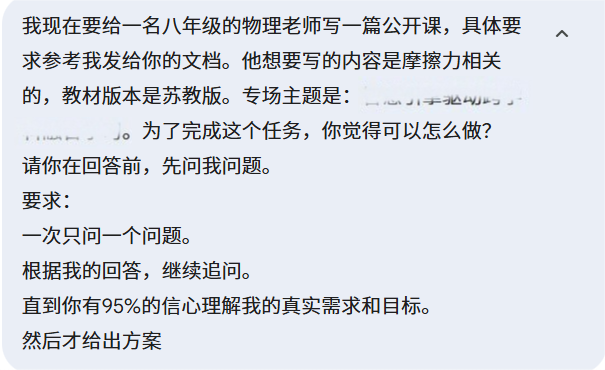

自从AI编程真的可以落地之后,程序员的日常都变成了这样:

这就是现状,Token 烧得飞快,有效信息密度却低得可怜。

AI是个工具,我们不是跟它谈恋爱,不需要听它说那么多废话。

你付的是按 Token 计费的 API 账单,但买到的却是一大堆“好的”、“我很高兴…..”、“当然”等等这种无效沟通,浪费钱,也浪费时间去看。

所以问题来了,能不能让 AI 把嘴闭上,只吐干货?

能。而且已经有人把这事儿干成了,还在 GitHub 上拿了57.9k Star。

它在 AI 的 system prompt 里塞了一套规则,告诉 AI:

- 删掉客套话

- 保留技术术语、代码块、文件路径、错误信息,一个字不许动

- 把复杂的长尾词换成简单的词

- 允许用碎片化短句,不追求语法完整

如果开 ultra 模式,单条中文回答的压缩率能接近 80%。

来看一段。

🗣️ 常规(109 tokens)

最夸张的是架构讲解和组件实现类问题,能压掉 87%。

功能特点

阅读速度变快了

以前 AI 回一大段,我得扫两三眼才能看到结论,现在它直接丢结论,一眼看完,不绕弯。

上下文更耐用了

上下文长度都是有限制的,这样的话就不用频繁去压缩了。

技术准确性没掉

这是我最在意的一点,caveman 的规则明确保护了代码块、技术术语、错误信息、文件路径,该精确的地方一字不差,该省略的地方一刀不软。

话多不代表更聪明,有时候少即是多。

项目链接

https://github.com/JuliusBrussee/caveman

© 版权声明

文章版权归作者所有,未经允许请勿转载。