<section data-role="outer" label="edit by 135editor" data-pm-slice="0 0

刘会,昝文,成佳伟,等.教育大语言模型的应用现状、安全风险与应对策略[J].中国教育信息化,2026,32(03):64-73.

刘 会 昝 文 成佳伟 夏 珺 杜 旭

摘 要:教育大语言模型在广泛赋能教育场景的过程中,逐渐暴露出内容生成错误、隐私泄露、算法偏差与滥用等多重安全风险,对教学活动的可靠性和教育生态的稳定性构成潜在威胁。针对这些问题,研究者以信任风险矩阵为核心分析框架,对教育大语言模型在部署与使用过程中可能出现的风险进行系统梳理与结构化审视,从风险特征、教育场景表现以及信任影响机制三个层面展开分析,识别出版权保护困难、内容安全控制不足、幻觉问题频发、数据隐私防护薄弱等突出风险点,并结合具体教育环节总结其表现形式,进而阐述其形成路径以及对合法信任、伦理信任、知识信任与数据信任的影响。基于上述分析,提出适用于教育场域的系统化风险治理策略,包括强化版权管理、优化内容审查流程、构建知识验证体系以及健全隐私保护措施,旨在为教育大语言模型安全与稳定运行提供支持,并为构建可信的智慧教育新生态提供理论基础和实践指引。

关键词:教育大语言模型;信任风险矩阵;版权保护;数据隐私;智慧教育

文章编号:1673-8454(2026)03-0064-10作者简介:刘会,华中师范大学计算机学院讲师、硕士生导师,人工智能与智慧学习湖北省重点实验室成员,博士(湖北武汉 430079);昝文、成佳伟,华中师范大学计算机学院(湖北武汉 430079);夏珺,华中师范大学心理学院中级实验员,硕士(湖北武汉 430079);杜旭,通讯作者,华中师范大学人工智能教育学部教授、博士生导师,博士(湖北武汉 430079)

基金项目:2023年度国家资助博士后研究人员计划“慕课学习平台人脸识别隐私保护方法研究”(编号:GZC20230922);2024年度中国博士后科学基金第75批面上资助项目“面向慕课人脸识别的主动隐私保护方法研究”(编号:2024M751050);2024年度湖北省博士后创新人才培养项目“面向模型反演攻击的慕课人脸认证隐私保护方法及应用研究”(编号:2024HBBHCXB042);人工智能与智慧学习湖北省重点实验室2025年度开放研究基金项目“基于人脸图像的学业情绪匿名感知方法”(编号:2025AISL007)

随着生成式预训练模型的高速迭代,大语言模型正以其对信息的广度聚合、深度分析、创新预测等功能在教育领域大放异彩[1]。通过大模型构建的个性化学习路径,不仅提高了教育教学效率,还基于大数据的预测,为不同学习者精准匹配学习内容与进阶路线,一定程度上实现了“有教无类”[2]。大语言模型在教育领域的深入应用,不仅加速传统教学模式的转型升级,也助推科教兴国战略的深入实施,展现出强劲的发展潜力。 教育大语言模型(Educational Large Language Model,ELLM)在带来便利的同时,也潜藏着诸如隐私泄露、滥用风险、版权问题等安全风险[3]。为规范大语言模型应用,2023年7月,我国发布《生成式人工智能服务管理暂行办法》[4],要求“生成式人工智能服务提供者依法开展预训练、优化训练等数据处理活动”。2025年4月,教育部等九部门联合印发的《关于加快推进教育数字化的意见》提出,“构建网络安全防护体系”“强化人工智能安全保障”[5]。2025年9月正式发布的《人工智能安全治理框架》2.0版本[6],要求“推动形成涵盖技术防护、价值对齐、协同治理等多层面的可信人工智能基本准则”。 当前,利用大语言模型赋能教育教学已取得显著成效,在自动答疑、作业批改、个性化学习推荐、学习分析等方面展现出较强的应用潜力。然而,现有研究主要聚焦功能实现与教学效果评估,对于模型在教育场景下可能带来的安全风险及系统应对策略仍缺乏充分探讨。针对这一问题,本文首先梳理了ELLM的应用现状,深入分析其主要安全隐患,明确指出现有ELLM在版权保护、内容安全、幻觉、数据隐私等方面的不足,并提出针对性应对策略,旨在探索ELLM的安全保障路径,提升其在教育领域的可信性与稳定性。

(一)ELLM概述 ELLM的构建与优化主要依赖架构设计、数据质量、算力支持三个核心要素[7]。 1.架构设计 ELLM通常采用Transformer模型结构,通过多头注意力机制实现对教育文本的深度理解与生成。近年来,研究者进一步优化模型架构,引入稀疏注意力机制以降低计算复杂度[8]。同时,ELLM引入基于知识图谱的嵌入技术,以增强模型对教育领域知识的表征能力[9]。 2.数据质量 ELLM的训练主要依赖大规模、高质量的教育语料库,包括教材、习题、学术论文等。研究表明,经过领域特定数据微调的模型在教育任务中的性能显著优于通用模型。此外,数据多样性对模型性能至关重要,跨学科、多语言数据的引入进一步提升了模型的泛化能力[10]。 3.算力支持 分布式训练技术和硬件加速器(如GPU和TPU)的普及,显著降低了模型训练的时间和成本。例如,采用混合精度训练可将训练速度提升2—3倍,同时减少内存占用[11]。此外,边缘计算技术的应用使ELLM能够在包括课堂实时问答在内的低延迟场景下高效运行。 (二)发展趋势 2023年以来,ELLM行业在技术创新与应用突破方面开始飞速发展。华经产业研究院发布的《2025—2031年中国教育大模型行业发展全景监测及投资方向研究报告》显示[12],2024年,中国教育大模型市场规模约为0.4亿元。随着“AI+教育”相关政策的相继出台,行业市场需求持续扩大。面向不同应用场景和需求的ELLM不断涌现,呈现多样化的发展趋势。表1列出2023—2025年以来具有代表性的ELLM,并归纳其主要特点,进一步展示了教育大模型的发展演进路径。这些模型不仅反映了该领域的最新进展,也预示了未来教育变革的潜在方向。表1 主流ELLM及其主要特点

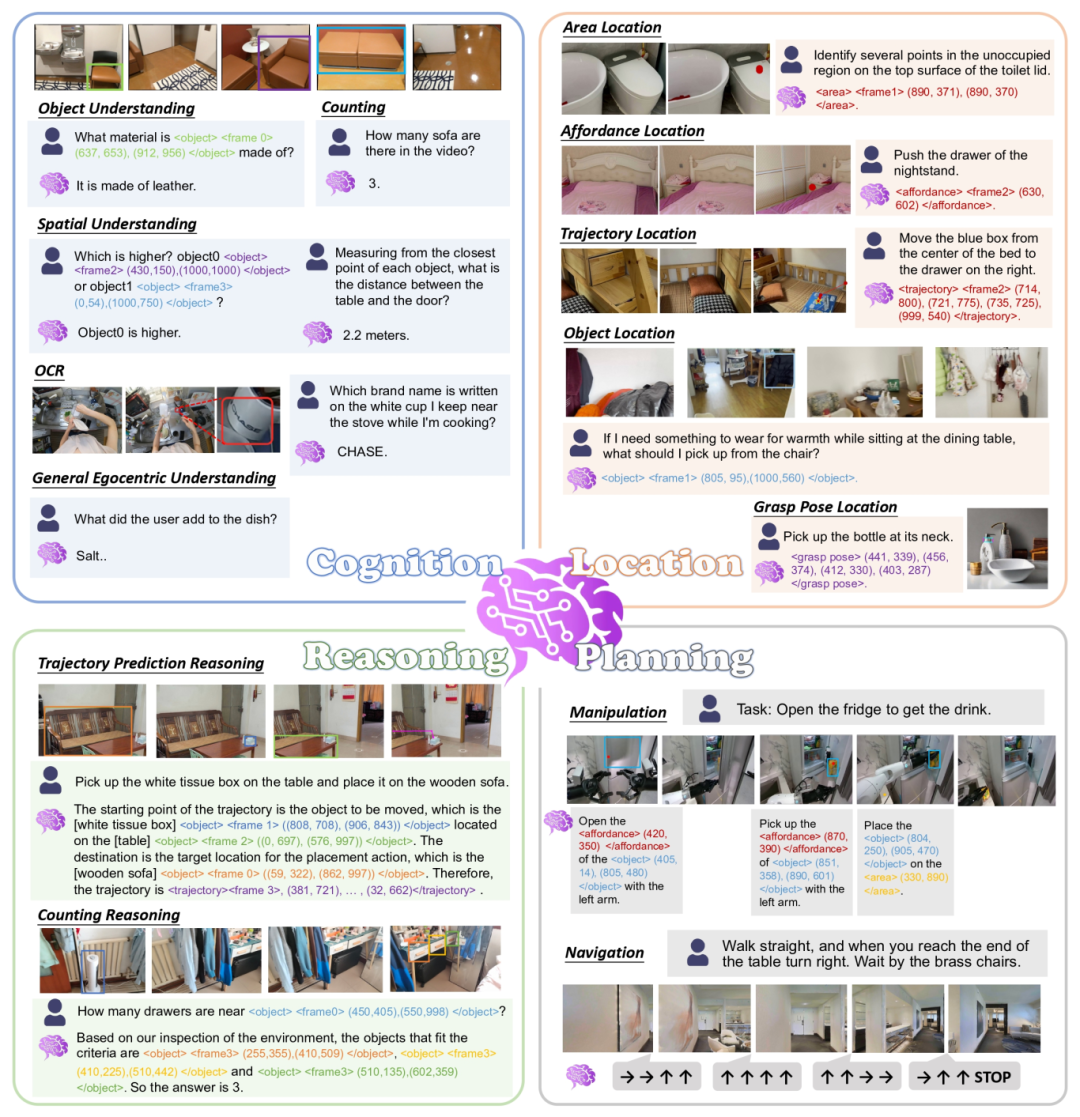

(一)ELLM信任风险矩阵构建 为揭示ELLM在教学场景中潜在的信任风险,本文引入并构建了信任风险矩阵。该矩阵遵循“理论引导、维度选取、路径映射”的三阶段逻辑路径,旨在实现从抽象原则到具体教育情境的逐层转化与结构化表达。 1.理论引导 本研究以可信人工智能的核心原则为理论基础,聚焦合规性、伦理性、准确性、数据安全四大基本维度。这些原则构成识别和归类ELLM应用中潜在信任问题的价值基准,为后续风险范畴的界定提供了坚实的理论支撑。 2.维度选取 结合现有研究成果与教育场景的实际应用需求,本文将潜在风险归纳为版权保护困难、有害内容生成、幻觉问题与隐私泄露四类。四类风险分别对应教育实践中的典型痛点,包括学术诚信、教学公平、知识可靠性与数据安全。 3.路径映射 本研究从风险特征、教育场景表现、信任影响机制三个层次展开分析,首先界定各类风险的内在特征,再结合相应教育环节(如作文写作、知识问答、成绩管理等)提炼其具体表现,进而揭示其作用路径,最终映射至合法信任、伦理信任、知识信任与数据信任四个层面。 通过以上步骤,本文形成表2所示的ELLM信任风险矩阵。该矩阵不仅揭示了版权保护困难、有害内容生成、幻觉问题、隐私泄露四个关键维度下的潜在威胁及其影响路径,还进一步说明四类风险分别指向法律、道德、认知、数据安全等不同层面。这些风险最终汇聚为同一个核心问题:教育参与者对ELLM的信任是否足以支撑其长期、安全地融入教学实践。表2 ELLM信任风险矩阵

(二)版权保护困难:合法性信任的受损 1.内生版权 ELLM的开发往往依赖于庞大的计算资源和高成本的技术投入,因此开发者对其成果拥有较强的知识产权保护基础。然而,随着知识蒸馏等模型压缩技术的不断发展,未经授权的第三方可以借助低成本手段重建在功能上高度相似的模型,而无需直接复制原始模型结构或参数[13]。知识蒸馏通过将复杂模型中的知识迁移到更轻量的模型中,使这些“学生模型”在输出效果上可以接近原始“教师模型”,为潜在的知识产权规避提供了技术途径。因此,该类技术的广泛应用也对原创大语言模型成果的知识产权保护构成前所未有的挑战。 2.内容版权 生成式人工智能技术通过对海量数据的处理,能够自动生成各种形式的内容,包括文本、图像、音频等[14]。这些生成的内容通常与现有作品在风格、结构或表达方式上高度相似,甚至在某些情况下几乎完全雷同。例如,学生可能借助ELLM生成的内容,将其作为自己的作业提交给教师进行批改,或用其参与各类学术及创意竞赛。这不仅损害了教育公平,也可能对原创性和学术诚信产生不良影响。随着生成式人工智能技术的普及,如何有效检测和防范这种新型的“作弊”行为,确保教育评价的公正性,并保护ELLM生成内容的版权,已成为当前教育领域亟待解决的主要挑战。 (三)有害内容生成:社会伦理信任的动摇 1.意识形态安全风险 大语言模型的训练数据通常来自互联网,难免包含一些社会中存在的偏见和刻板印象[15]。这类模型在生成内容时,可能带有性别、种族、宗教或文化方面的偏见,如出现性别歧视性表述,或对特定群体做出不公正的描述。如此类偏见性输出未能及时得到监控和纠正,不仅可能加剧社会不平等,还会在教育场景中对学生的价值观和社会认知造成潜在的负面影响。更为严重的是,ELLM可能生成违背社会主义核心价值观或与社会伦理相冲突的内容,如一些不当内容可能误导用户形成对社会的错误认知,甚至造成社会意识形态的偏离[16]。 2.情感理解不完善 当前,ELLM在情感理解与处理方面尚不完善[17]。生成的内容可能无法准确识别学生的情感需求或心理状态,甚至可能产生带有负面情绪的言辞。例如,某些生成的内容可能无意间加剧学生的焦虑、压力或自我怀疑,尤其是在提供心理咨询或情感支持时。如果模型的情绪处理机制未能得到有效优化,可能会导致学生的心理负担进一步加重,进而影响其学习成绩、身心健康,甚至可能导致情绪问题的恶性循环。因此,完善ELLM的情感理解能力,是保障学生心理健康和教育效果的关键[18]。 (四)幻觉问题:信息可信度的侵蚀 1.事实性幻觉 大模型的“事实性幻觉”指的是模型在生成内容时,输出与真实世界事实不符的内容[19]。这种幻觉不仅包括虚构信息,还可能源自模型基于不完整或错误数据进行的错误推理或假设。例如,在科学领域,模型可能误解某些科学原理,导致传播不准确的科学知识;在历史内容描述中,模型可能错误地给出事件的时间、地点,甚至虚构不存在的历史情节。ELLM中的事实性幻觉尤具风险,它可能误导学生接受错误信息,从而影响其对特定概念、理论或历史事件的准确理解。在教育过程中,这种错误信息的传播不仅影响学习效果,还可能影响学生的批判性思维和判断能力。 2.忠诚性幻觉 “忠诚性幻觉”指的是大模型在生成内容时,过度迎合用户的输入或特定指令,从而生成不符合事实或不恰当的回答[20]。这种幻觉通常源于模型试图满足用户的期望或需求,结果生成了错误的内容或推论,尽管这些内容可能不准确或违反道德伦理。在生成学术内容时,模型可能会为支持某一观点而虚构研究成果,甚至伪造引用。由于模型的训练数据来源广泛且未经严格筛选,生成的信息往往基于未经验证的内容。这种幻觉使得模型输出看似权威,但实际上缺乏真实依据,容易误导学生和研究人员。随着ELLM的广泛应用,虚假信息传播的速度加快,可能影响公众的知识获取,甚至塑造社会舆论,从而削弱人们对权威信息和真实事件的信任。 (五)数据隐私泄露:数据安全信任的崩塌 1.训练数据泄露 大模型的性能在很大程度上依赖于大规模、高质量的数据进行训练。然而,在数据的采集、处理与模型训练过程中,容易造成用户隐私或敏感信息被模型“记忆”,并在后续的交互中被意外泄露[21]。攻击者可以利用特定的提示词或诱导式提问,引导模型生成训练数据中的原始内容,例如社交媒体上的个人信息、在线教育平台中的学生记录、考试答案、心理健康信息等。这类数据一旦泄露,不仅侵犯个人隐私,还可能被用于网络诈骗,甚至引发更严重的信息安全事件。对于以青少年学生为主要服务对象的ELLM而言,这类风险更需高度警惕,因为一旦发生数据泄露事件,其社会影响广、伦理代价高,严重时甚至会破坏教育系统对人工智能的信任基础。 2.交互数据泄露 在与ELLM进行交互的过程中,学生和教师往往会输入包含个人隐私的数据,以获取更加个性化和精准的反馈。这些数据可能包括学习记录、学术成绩、情感状态、教学计划等敏感信息。然而,一些平台将用户的对话数据用于后续模型训练与优化,如果在未征得用户明确同意的情况下进行此类操作,便可能构成对个人隐私的严重侵犯[22]。特别是在教育场景中,学生的行为轨迹、学习偏好与思维过程本身就是高度敏感的信息,一旦泄露可能对学生造成持久影响。此外,ELLM还存在泄露学术及教育领域机密数据的潜在风险。例如,尚未发表的科研论文、项目申请书、评审材料、考试题库或教育机构的内部报告等,一旦通过模型生成过程被意外暴露,可能对学术研究的原创性和竞争力带来冲击,甚至损害教育资源的公平分配。

(一)加强版权管理 1.内生版权保护 为防止ELLM因知识蒸馏等途径被非法复制,可采用模型水印技术进行溯源与保护。主要方法包括以下三种:一是模型参数水印,即在模型权重中嵌入隐式信息,使其即便在经过蒸馏后仍能验证来源;二是训练数据水印,通过在训练数据中加入隐性标记,使未经授权训练出的模型携带可识别特征;三是输出水印,在生成内容中植入特定标记,以便追踪模型来源[23]。法律方面,可通过多维度方法保护模型的算法、架构和实现,如对模型结构、训练方法等申请专利,对代码和文档进行版权注册,并通过设立访问权限和安全协议防止数据泄露[24]。管理方面,可设立专门的知识产权部门,负责专利申请、侵权监测等,并与高校科研机构签署知识产权协议,明确ELLM技术成果归属和使用权,确保技术创新成果的合法权益[25]。 2.内容版权保护 为防止ELLM生成内容侵犯现有版权作品,技术上可建立自动化审核机制,结合机器学习和人工检测,识别生成内容(如文字、图片)中是否包含受版权保护的素材,并在生成内容中嵌入水印,实现溯源,降低侵权风险。管理上,设立专门的内容审核团队,规范数据来源,确保训练数据合法合规,避免使用未经授权的素材,必要时取得授权[26]。同时建立侵权监测机制,定期扫描网络内容,防止生成内容被非法商业化使用。法律方面,一旦发现侵权行为应快速响应,通过法律手段推动侵权内容下架,并建立快捷的侵权举报通道,便于受害方提交证据、及时维权,从而有效防范和应对ELLM内容侵权问题[27]。 (二)优化内容审查机制 1.价值观对齐 由于ELLM的训练数据主要来源于互联网,其内容中不可避免地包含一些多元化甚至相互冲突的价值观念。这种差异性若未得到有效约束,可能导致模型生成的信息与社会主义核心价值观及教育导向要求不一致,从而对学生的价值观形成产生潜在的负面影响。因此,ELLM的安全使用必须强调价值观对齐。一方面,应在模型训练和微调阶段引入符合教育规范和伦理要求的高质量语料,确保其输出符合主流价值导向;另一方面,需要建立动态审查与反馈机制,对模型生成内容进行实时监测和多层过滤,防止不当价值观渗透。同时,可通过引入教师监督与人机协同方式,实现对模型输出的价值校正,确保教育过程中的信息传递始终符合正确的政治立场与社会规范。通过上述措施,ELLM不仅能够提升教学智能化水平,更能够在意识形态安全和价值引领方面发挥积极作用。 2.情感交互治理 当前ELLM在情感识别与回应方面仍面临挑战,如难以精准捕捉学生隐含情绪,或在复杂情境下作出机械判断。情感交互治理是一个复杂的问题,需要构建多维度的改进和优化方案[28]。首先,通过整合文本、语音、表情等多模态数据,建立立体化情感分析模型,全面感知学生情感状态;其次,开发教育场景专属情感语料库,结合专家标注与真实互动案例动态优化,使模型深度适应教育语境;再次,在应用层面设计人机协同机制,由教师复核模型生成的情感反馈,避免潜在不良影响;最后,需强化价值引导与内容审查体系,确保情感输出符合教育伦理与社会规范。通过技术迭代与制度设计并行,ELLM不仅可提升情感解析能力,还能在安全边界内实现更有温度的教育辅助价值。 (三)构建知识验证体系 1.检索增强生成 检索增强生成(Retrieval-Augmented Generation,RAG)是一种结合外部知识检索与文本生成的技术,通过引入权威信息辅助模型生成更准确、可信的内容[29]。在内容生成过程中,ELLM首先检索外部知识库,并利用检索技术获取与用户问题最相关的权威信息作为参考。通过这种方式,ELLM可以有效降低生成内容与事实不符的风险,确保所生成的内容更符合实际。当用户提出问题时,系统会调用外部知识库,并结合ELLM生成的初步回答进行交叉验证,从而提高内容的准确性和可信度。通过这种检索和生成相结合的方式,模型能够更好地处理涉及历史事件、科学知识等敏感领域的问题,减少常见的事实性错误。对于需要严谨性和可靠性的教育内容,RAG技术尤为重要,能够帮助确保模型生成的信息不仅符合学术标准,还能避免错误信息的传播。 2.知识图谱验证 利用知识图谱验证可以有效缓解ELLM的幻觉问题,尤其是在生成内容时确保其准确性和事实可靠性[30]。ELLM可能会产生错误信息或虚构内容,尤其是在涉及历史事件、学术引用或复杂知识时,通过引入知识图谱进行校验,可以对模型生成的实体和关系进行准确验证。在学术领域,知识图谱的作用尤为关键,它能够验证学术引用的真实性,防止ELLM生成虚假的研究成果或引用不存在的文献。如果ELLM在生成学术论文时错误地引用了不存在的研究或不准确的研究结果,知识图谱可以帮助识别这些问题,确保生成内容的可靠性和学术价值。知识图谱不仅能防止ELLM生成虚假信息,还能帮助ELLM避免产生“幻觉”,即那些与现实世界知识不符的内容,从而提高生成内容的准确性和可信度[31]。 (四)健全隐私保护措施 1.保护训练数据隐私 在保护ELLM训练数据的隐私时,首先需要严格控制数据的采集、存储和使用流程。为确保数据隐私,学校应采取数据脱敏技术,隐藏学生的个人信息、成绩等敏感数据。其次,模型的训练过程应遵循最小化数据暴露的原则,避免将过多的私人数据输入模型中,通过联邦学习等技术,让数据在本地处理,避免将敏感信息传输到中央服务器[32]。再次,加强对数据存储和访问的安全管理,采用先进的加密技术保护存储中的数据,并且确保只有授权人员可以访问。最后,通过透明化的隐私政策和用户授权机制,增强用户对数据隐私保护的信任,确保ELLM的使用在合法、合规的框架内进行,最大程度地保护学生和用户的隐私安全[33]。 2.保护交互数据隐私 保护ELLM交互数据的隐私,首先,需要确保所有交互数据的加密传输,避免数据在传输过程中被截获或篡改,使用加密协议保障数据从用户端到服务器端的安全性,确保数据在传输过程中无法被非授权人员访问[34]。其次,应对交互数据进行匿名化或去标识化处理,即去除学生的身份信息,避免在模型的处理过程中泄露个人隐私。为了增强数据隐私保护,还可以采取差分隐私技术,在数据交互的过程中引入噪声,确保即使模型对数据进行分析,也无法精确重构出用户的敏感信息[35]。 学校应严格控制用户数据的存储与访问权限,采用分层加密的存储策略,确保敏感数据仅对经过授权的人员开放访问,并对所有访问行为进行详尽的日志记录与审计[36]。同时,应结合透明的隐私政策与完善的用户同意机制,使用户充分了解其数据的使用方式,并拥有对数据使用权限的主动控制权[37]。通过本地化部署ELLM,可有效防止用户交互数据在传输过程中的泄露,从而切实提升隐私保护水平[38]。通过这些措施,不仅可以保护交互数据的隐私,还能建立用户对ELLM的信任,促进人工智能在教育领域的可持续发展。

ELLM在推动教学模式变革、实现个性化学习、提升教学效率等方面展现出广阔前景,正逐步成为智慧教育发展的核心支撑。然而,伴随该技术的迅猛发展,其所带来的内容安全、算法偏差、数据隐私等问题日益凸显,对教育系统的稳定性与公信力构成挑战。为促进ELLM的规范应用与可持续发展,本文系统梳理了其在教育领域的应用现状与演进趋势,基于信任风险矩阵,从法律、道德、认知、数据安全等不同层面,深入分析实际应用中面临的版权保护困难、有害内容生成、模型幻觉、用户隐私泄露等主要安全风险。针对上述风险,本文提出涵盖技术、制度与治理三个层面的综合防御策略,包括强化版权管理、优化内容审查机制、构建知识验证体系以及健全数据隐私保护措施,旨在为“人工智能+教育”的融合发展提供安全保障和理论支撑,助力构建可信、高效、可持续的智慧教育新生态。

[1]刘石奇,刘智,段会敏,等.大模型驱动的教育多智能体系统应用研究——技术架构、发展现状、实践路径与未来展望[J].远程教育杂志,2025,43(1):33-45. [2]教育部高等教育司.教育部高等教育司关于公布第二批“人工智能+高等教育”应用场景典型案例的通知[EB/OL].(2024-11-14)[2025-02-16].http://www.moe.gov.cn/s78/A08/tongzhi/202411/t20241118_1163542.html. [3]姜毅,杨勇,印佳丽,等.大语言模型安全与隐私风险综述[J].计算机研究与发展,2025,4:1-41. [4]国家互联网信息办公室等七部门.生成式人工智能服务管理暂行办法[EB/OL].(2023-07-10)[2025-07-13].https://www.gov.cn/gongbao/2023/issue_10666/202308/content_ 6900864.html. [5]教育部等九部门.教育部等九部门关于加快推进教育数字化的意见[EB/OL].(2025-04-11)[2025-07-15].https://www.gov.cn/zhengce/zhengceku/202504/content_7019045.htm. [6]全国网络安全标准化技术委员会,国家计算机网络应急技术处理协调中心.人工智能安全治理框架2.0[EB/OL].(2025-09-15)[2025-11-10].https://www.cac.gov.cn/2025-09/15/c_1759653448369123.htm. [7]刘邦奇,喻彦琨,王涛,等.人工智能教育大模型:体系架构与关键技术策略[J].开放教育研究,2024,30(5):76-86. [8]VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need[C]//Advances in neural information processing systems, December 4-9, 2017, Long Beach, California. New York: Curran Associates, 2017:5998-6008. [9][30]张天成,田雪,孙相会,等.知识图谱嵌入技术研究综述[J].软件学报,2023,34(1):277-311. [10]肖建力,黄星宇,姜飞.智慧教育中的大语言模型综述[J].智能系统学报,2025,4:1-17. [11]NARANG S, DIAMOS G, ELSEN E, et al. Mixed precision training[C]//International Conference on Learning Representation, April 30-May 3, 2018, Vancouver, British Columbia. New York: Curran Associates, 2018:1-12. [12]华经情报网.2025—2031年中国教育大模型行业发展全景监测及投资方向研究报告[EB/OL].(2024-12-10)[2025-02-16].https://www.huaon.com/channel/software/1033325.html. [13]LIU J, ZHANG C, GUO J, et al. Ddk: Distilling domain knowledge for efficient large language models[C]//Advances in Neural Information Processing Systems, December 10-15, 2024, Vancouver, British Columbia. New York: Curran Associates, 2024:1-23. [14]WANG K, CHANG K, WANG M, et al. Rtlmarker: Protecting llm-generated rtl copyright via a hardware watermarking framework[C].//Proceedings of the 30th Asia and South Pacific Design Automation Conference, January 20-23, 2025, Tokyo, Japan. New York: ACM, 2025:808-813. [15]RAJ C, MUKHERJEE A, CALISKAN A, et al. Breaking bias, building bridges: Evaluation and mitigation of social biases in llms via contact hypothesis[C]//Proceedings of the AAAI/ACM Conference on AI, Ethics, and Society, October 21-23, 2024, San Jose, California. California: AAAI Press, 2024:1180-1189. [16]徐磊,胡亚豪,潘志松.针对大语言模型的偏见性研究综述[J].计算机应用研究,2024,41(10):2881-2892. [17]伍海燕,何翠琳,曲由之,等.大语言模型的情感智能及其心理学应用[J].科技导报,2025,43(3):47-58. [18]吴海燕,虞小江,孙超群,等.基于教师—学生模型的隐式情感推理[J].清华大学学报(自然科学版),2025,4:1-11. [19][20]刘泽垣,王鹏江,宋晓斌,等.大语言模型的幻觉问题研究综述[J].软件学报,2025,36(3):1152-1185. [21]HUANG Z, LIU Y, HE D, et al. DF-MIA: A distribution-free membership inference attack on fine-tuned large language models[C]//Proceedings of the AAAI Conference on Artificial Intelligence, February 25-March 4, 2025, Philadelphia, Pennsylvania. California: AAAI Press, 2025:343-351. [22]YAO Y, DUAN J, XU K, et al. A survey on large language model security and privacy: The good, the bad, and the ugly[J]. High-Confidence Computing, 2024,4(2):100211. [23]ZHANG R, HUSSAIN S S, NEEKHARA P, et al. REMARK-LLM: A robust and efficient watermarking framework for generative large language models[C]//33rd USENIX Security Symposium, August 14-16, 2024, Philadelphia, Pennsylvania. California: USENIX Association, 2024:1813-1830. [24]韩雨潇.人工智能大模型训练数据的版权风险与化解路径[J].中国出版,2025,2:54-59. [25][26]沈锡宾,刘鲲翔,刘红霞.大模型视域下科技期刊数据资产的定义、价值与策略[J].科技与出版,2024,11:80-87. [27]许茂恒.AIGC大模型中内源性幻觉难题溯源与版权规制路径[J].北京理工大学学报(社会科学版),2024,26(6):98-108. [28]王笑尘,张坤,张鹏.多视角看大模型安全及实践[J].计算机研究与发展,2024,61(5):1104-1112. [29]CHEN J, LIN H, HAN X, et al. Benchmarking large language models in retrieval-augmented generation[C]//Proceedings of the AAAI Conference on Artificial Intelligence, February 20-27, 2024, Vancouver, British Columbia. California: AAAI Press, 2024:17754-17762. [31]罗江华,张玉柳.多模态大模型驱动的学科知识图谱进化及教育应用[J].现代教育技术,2023,33(12):76-88. [32]KUANG W, QIAN B, LI Z, et al. Federatedscope-llm: A comprehensive package for fine-tuning large language models in federated learning[C]//Proceedings of the 30th ACM SIGKDD Conference on Knowledge Discovery and Data Mining, August 25-29, 2024, Barcelona, Spain. New York: ACM, 2024:5260-5271. [33][36]付志远,陈思宇,陈骏帆,等.大语言模型安全的挑战与机遇[J].信息安全学报,2024,9(5):26-55. [34]GUPTA B B, GAURAV A, ARYA V, et al. Enhancing user prompt confidentiality in Large Language Models through advanced differential encryption[J]. Computers and Electrical Engineering, 2024,116:109215. [35]ZHAO Y, CHEN J. A survey on differential privacy for unstructured data content[J]. ACM Computing Surveys, 2022,54:1-28. [37]李祎恒,陶媛.隐私政策下知情同意原则的适用困境与完善路径[J].行政与法,2025,3:104-115. [38]郑永红,王辰飞,张务伟.生成式人工智能教育应用及其规制[J].中国电化教育,2024,5:114-119.

Application Status, Risks and Security Issues,and Countermeasures of Educational Large Language ModelsHui LIU1,2, Wen ZAN1, Jiawei CHENG1, Jun XIA3, Xu DU4(1.School of Computer Science, Central China Normal University,Wuhan 430079, Hubei;2.Hubei Provincial Key Laboratory of Artificial Intelligence and Smart Learning, Central China Normal University,Wuhan 430079, Hubei;3.School of Psychology, Central China Normal University, Wuhan 430079, Hubei; 4.Faculty of Artificial Intelligence Education, Central China Normal University, Wuhan 430079, Hubei)

Abstract:In the process of extensively empowering educational scenarios, educational large language models (ELLMs) have gradually exposed multiple security risks such as content generation errors, privacy leakage, algorithmic bias, and abuse, posing potential threats to the reliability of teaching activities and the stability of the educational ecosystem. To address these issues, an analytical framework centered on the trust risk matrix conducts a systematic sorting and structured examination of the potential risks of ELLMs during deployment and use. The analysis is carried out from three dimensions: risk characteristics, manifestations in educational scenarios, and trust impact mechanisms. Prominent risk points are identified, including difficulties in copyright protection, insufficient content security control, frequent hallucination issues, and weak data privacy protection. Their manifestations are summarized in combination with specific educational links, and their formation paths as well as impacts on legal trust, ethical trustworthiness, knowledge trust, and data trust are further revealed. Based on the above analysis, systematic risk governance strategies applicable to the educational field are proposed, including strengthening copyright management, optimizing content review processes, establishing knowledge verification systems, and improving privacy protection measures. These strategies aim to provide support for the safe and stable operation of ELLMs and offer theoretical foundations and practical guidance for building a trustworthy new ecology of smart education.

Keywords:Educational large language model; Trust risk matrix; Copyright protection; Data privacy; Intelligent education